1、智能体编排

“智能体编排”是整个 Agent 平台的核心“大脑”构建中心,该模块主要用于定义智能体的底层逻辑、角色认知、能力边界以及工作流调度策略。通过高度模块化和可视化的编排界面,开发者可以零代码/低代码地打造出具备深度思考、外部工具调用及复杂业务处理能力的企业级 AI 助手。

- 智能体编排(核心逻辑层): 负责定义智能体的角色设定(Prompt 工程)、工作流走向以及核心指令逻辑,是决定智能体“思考方式”的大脑。

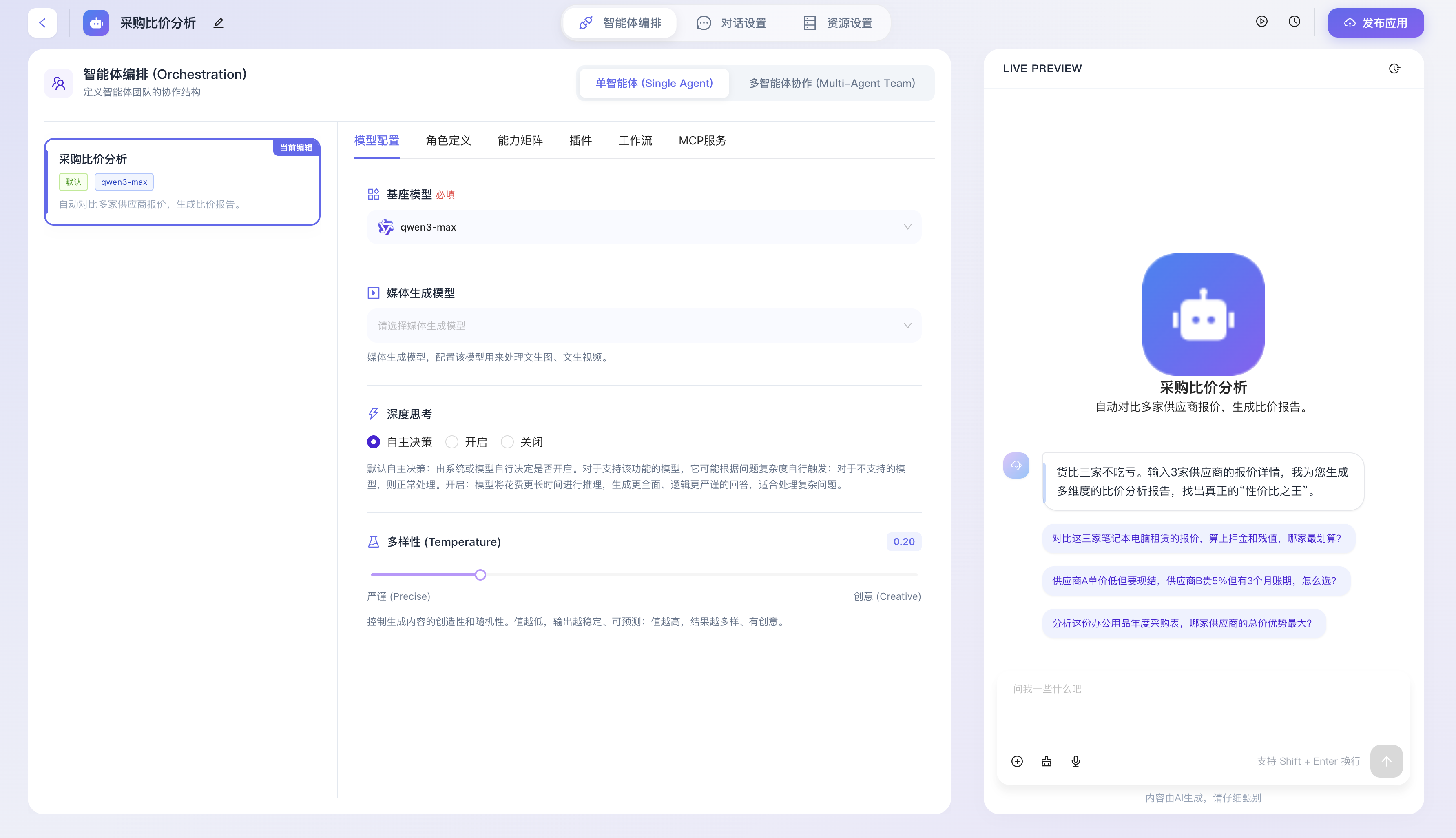

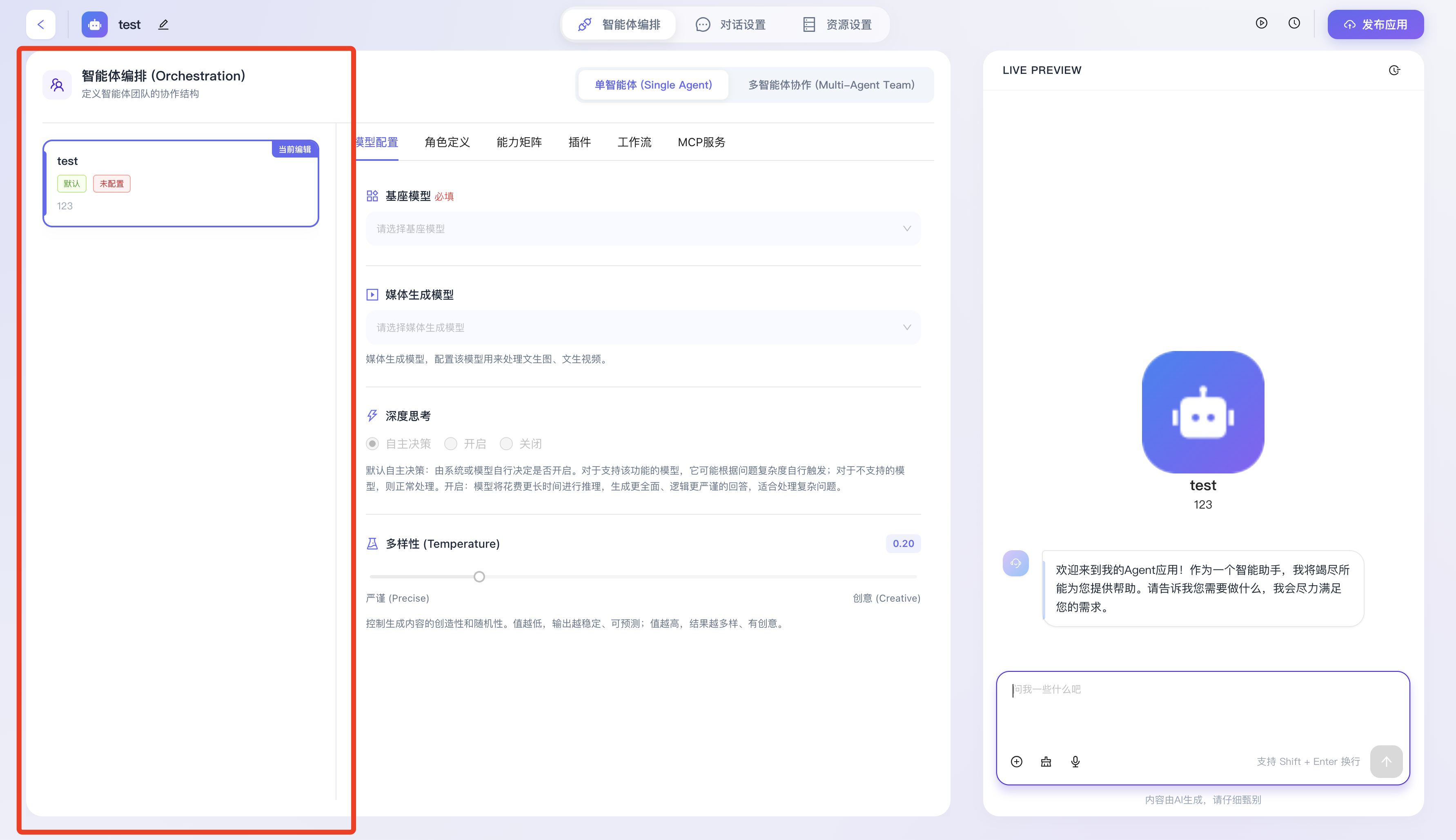

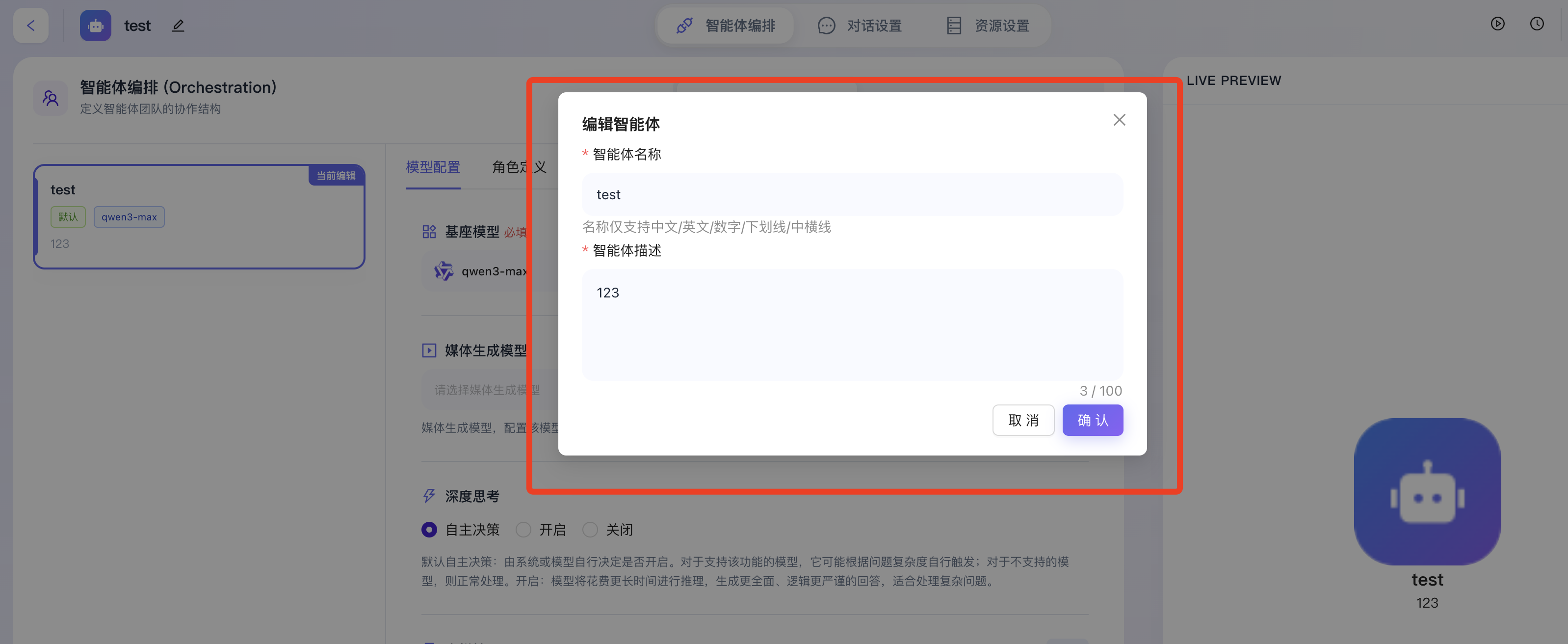

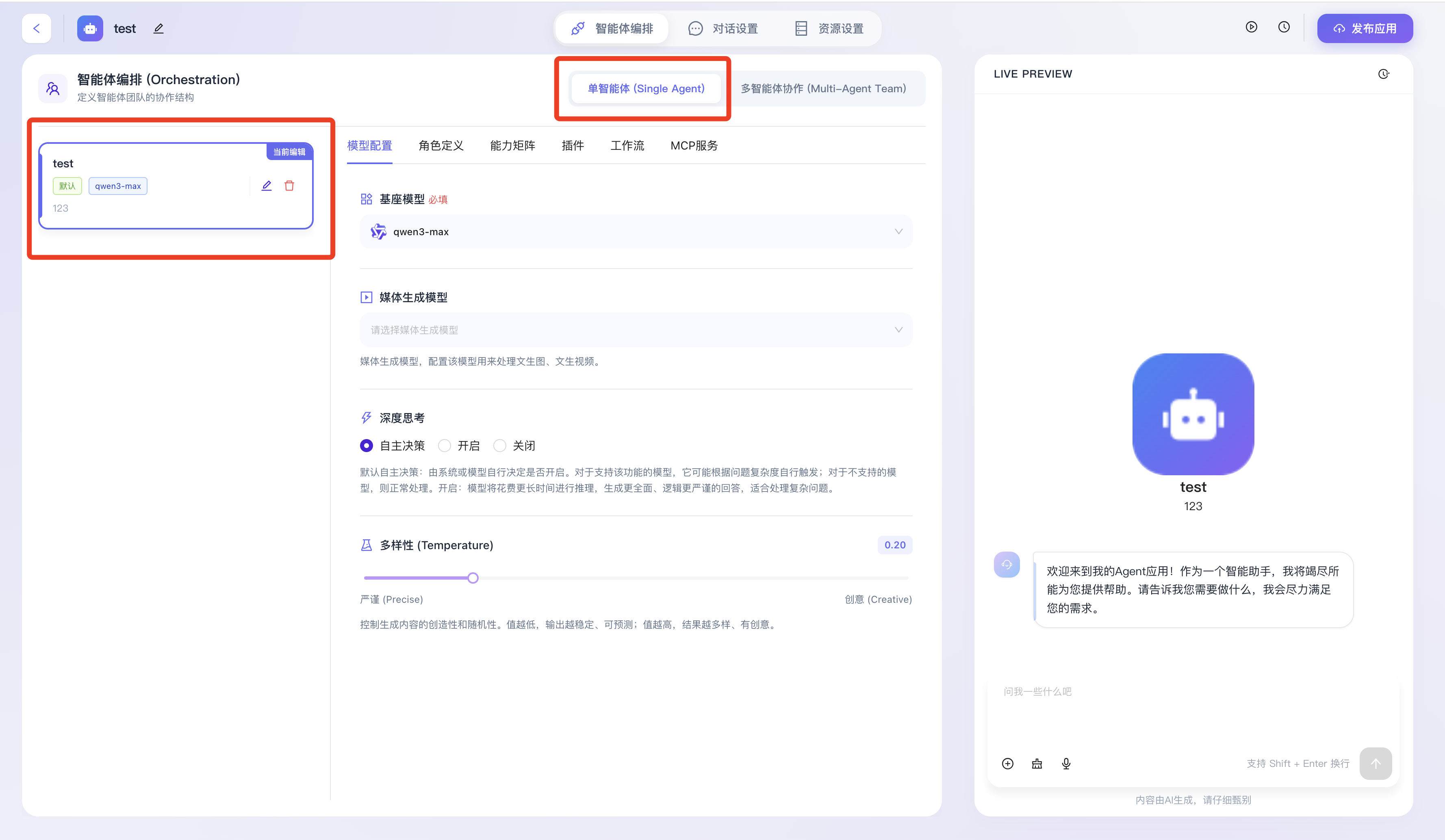

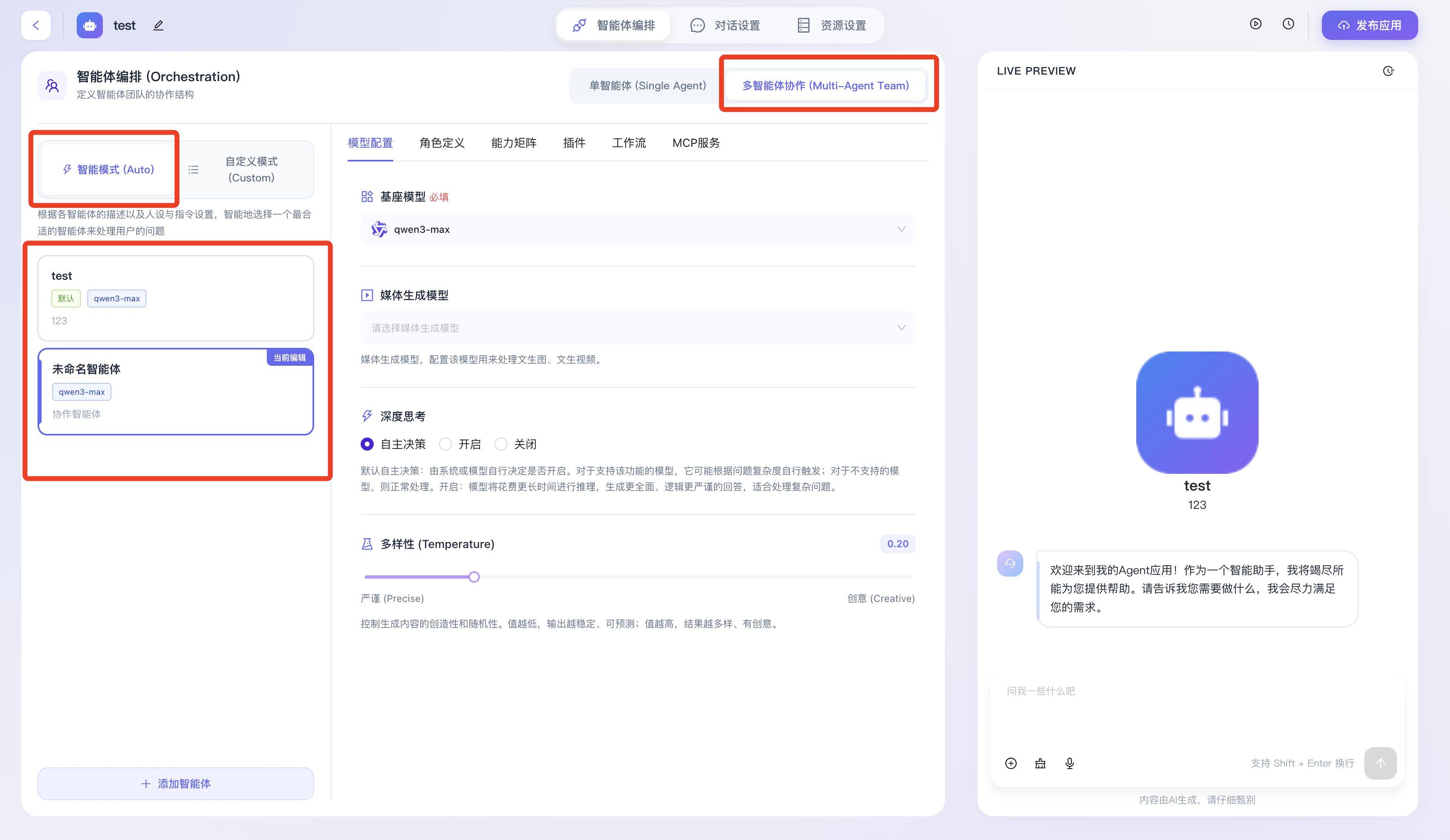

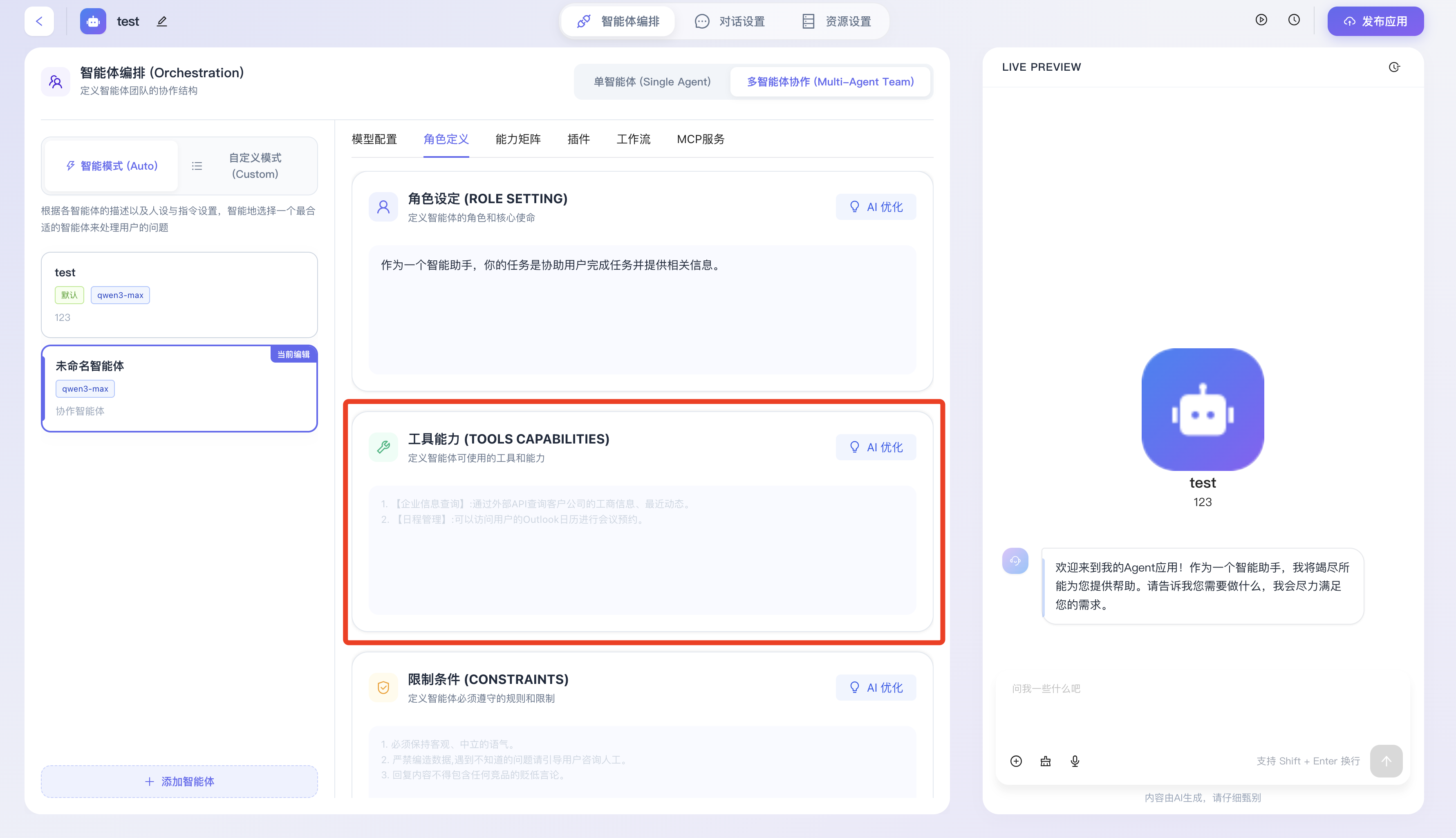

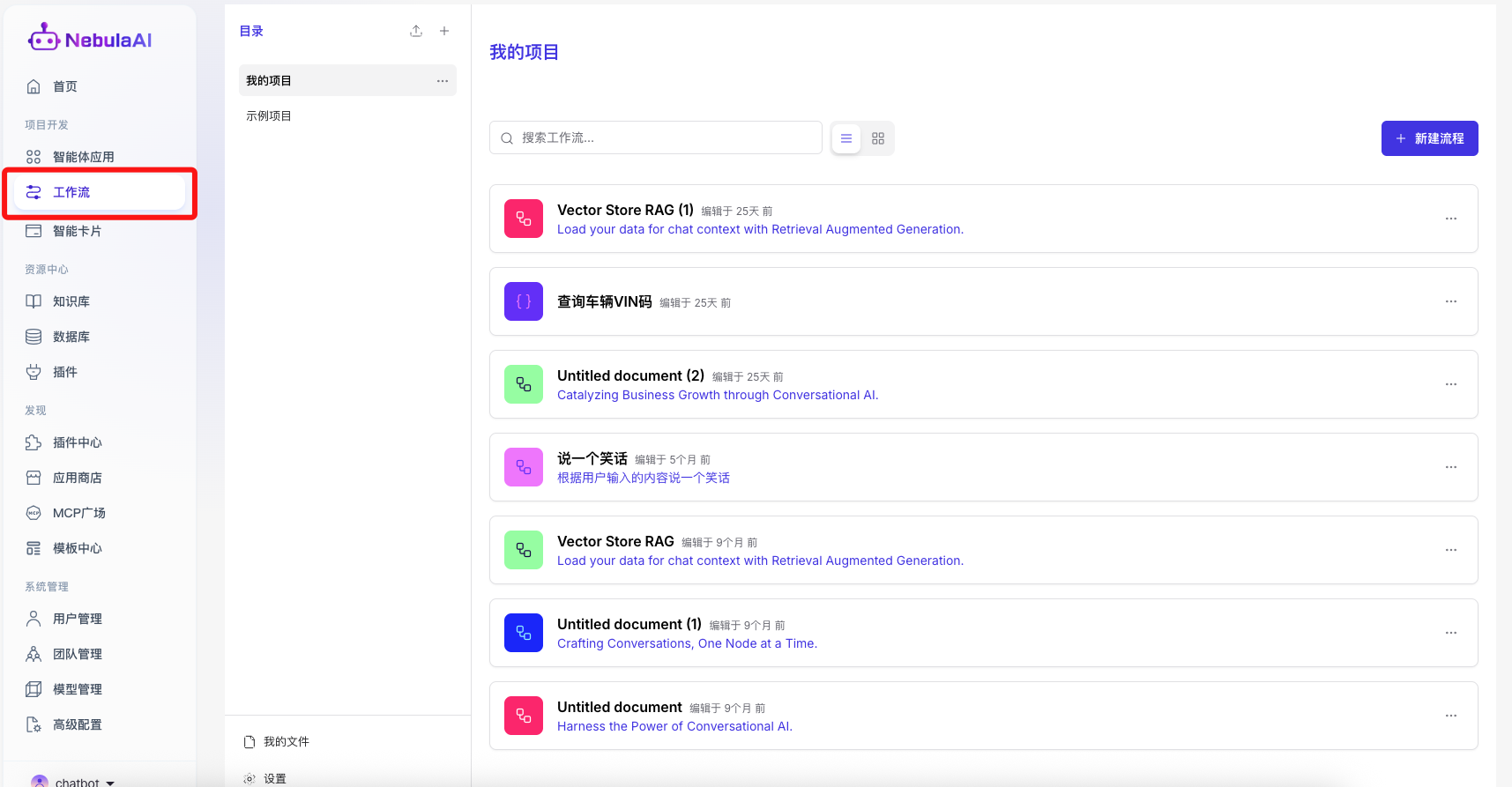

1.1 智能体列表

界面的顶端与左侧区域负责全局模式的切换与智能体实例的基础管理,提供清晰的层级视图。

包含的配置功能点如下:

- 智能体列表管理:

- 左侧面板展示当前编排项目下的智能体列表。选中状态下会高亮显示该 Agent 的名称、默认标签(首次创建智能体应用时,默认会创建一个智能体,该智能体不可删除)、当前挂载的模型版本(如 qwen3-max)及业务描述。

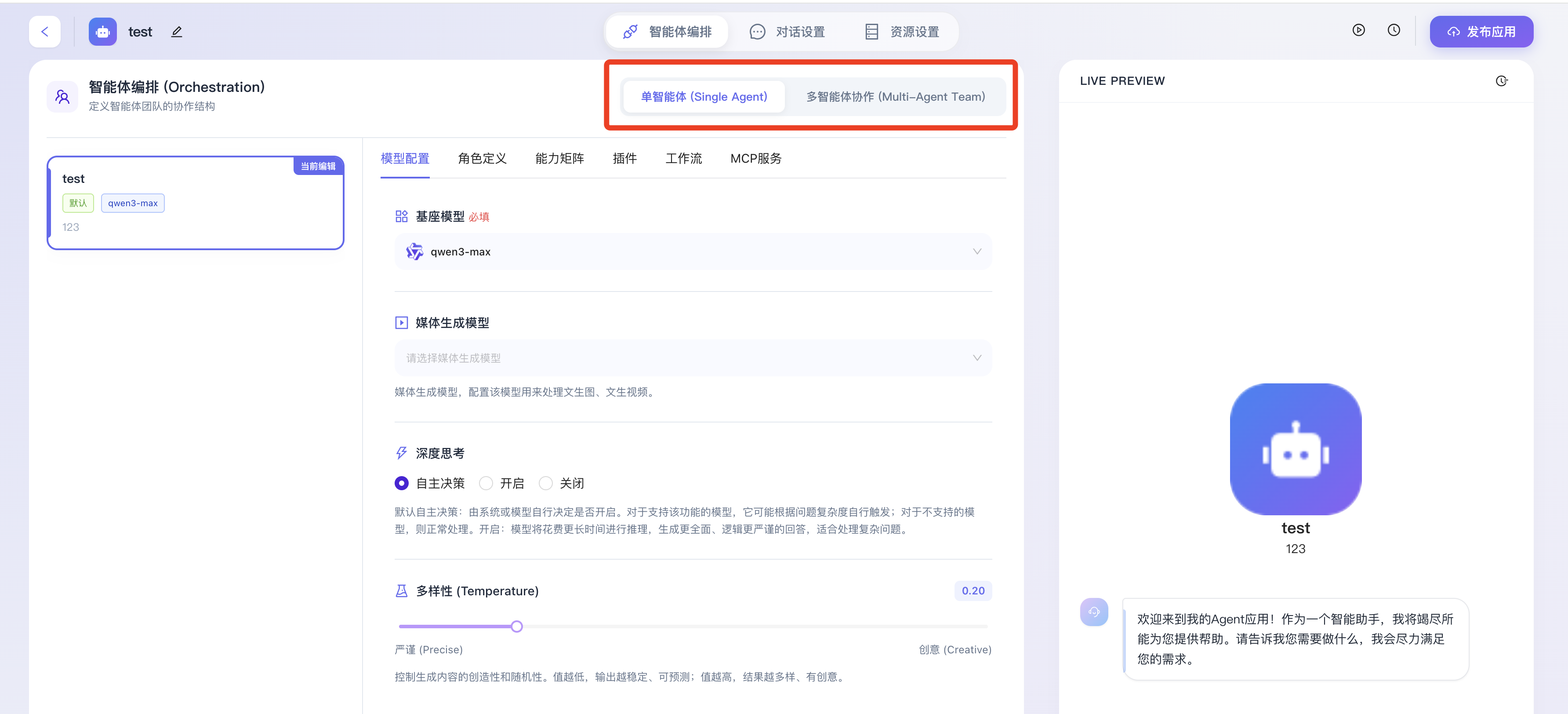

1.2 智能体模式

位于界面顶部中间,提供 “单智能体 (Single Agent)” 与 “多智能体协作 (Multi-Agent Team)” 的一键切换功能。开发者可根据业务复杂度,选择是构建专注单一垂直场景的独立 Agent,还是构建由多个不同职能 Agent 组成的复杂协作网络。

1.2.1 单智能体

在构建应用时,开发者可根据实际业务场景的复杂度,在页面右上角自由切换底层架构:

- 单智能体 (Single Agent):

- 场景描述: 适用于边界清晰、任务目标明确的垂直场景(如单一的文本翻译、特定规则的客服问答、独立的数据查询)。

- 功能价值: 架构轻量,响应极速,提示词(Prompt)收敛性强,能够以最低的算力成本高效解决特定专业问题。

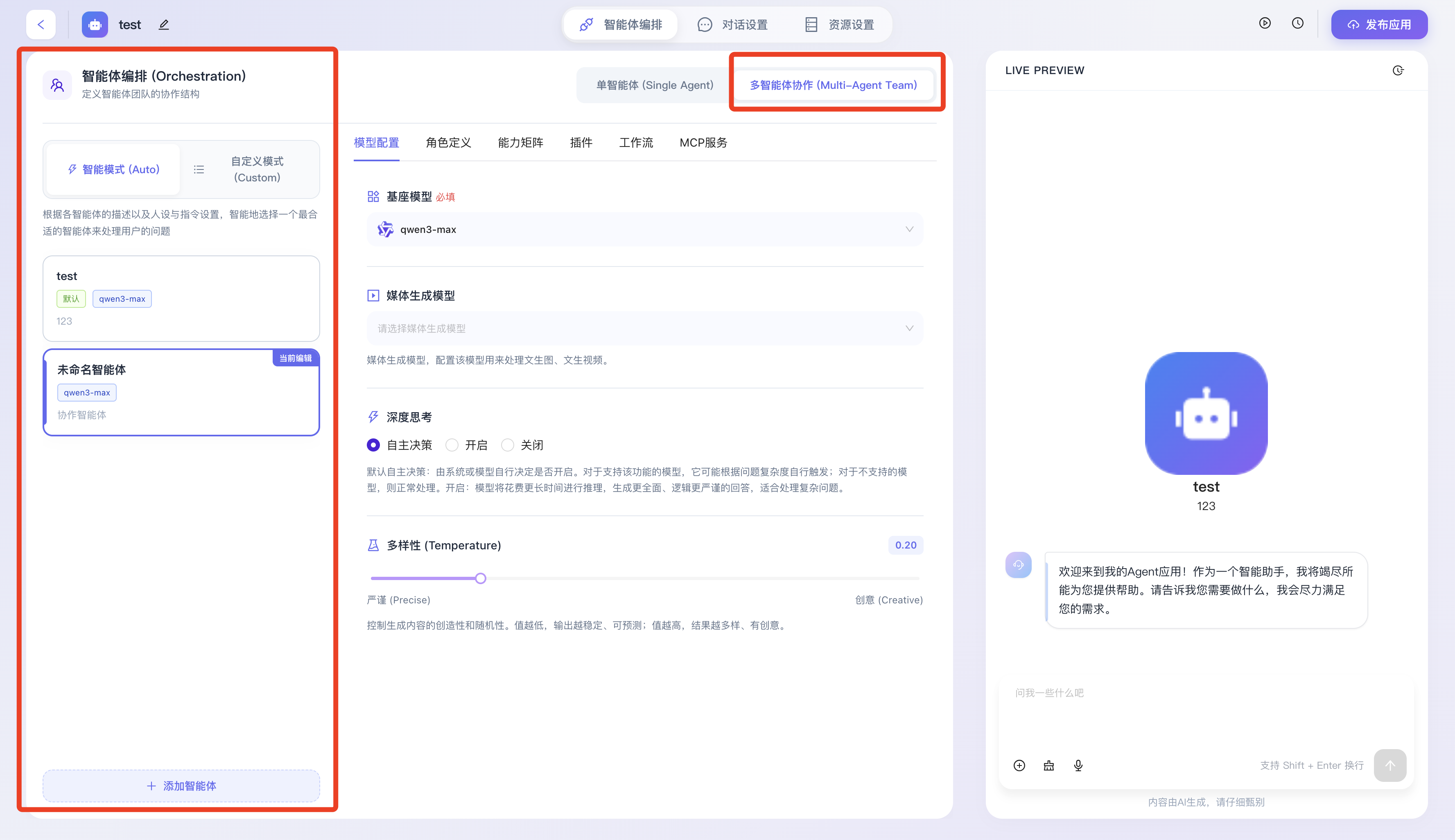

1.2.2 多智能体协作

在构建应用时,开发者可根据实际业务场景的复杂度,在页面右上角自由切换底层架构:

- 多智能体协作 (Multi-Agent Team):

- 场景描述: 适用于包含多步骤、跨领域知识整合、需要“思考-执行-审查”闭环的复杂业务流(如:研发效能全链路包含“需求分析专家+代码编写助手+代码审查专家”)。

- 功能价值: 通过解耦复杂任务,将大问题拆解为由不同“专家(子智能体)”处理的小问题。极大突破了单模型的上下文处理瓶颈与能力边界,涌现出更具深度和广度的复杂问题解决能力。

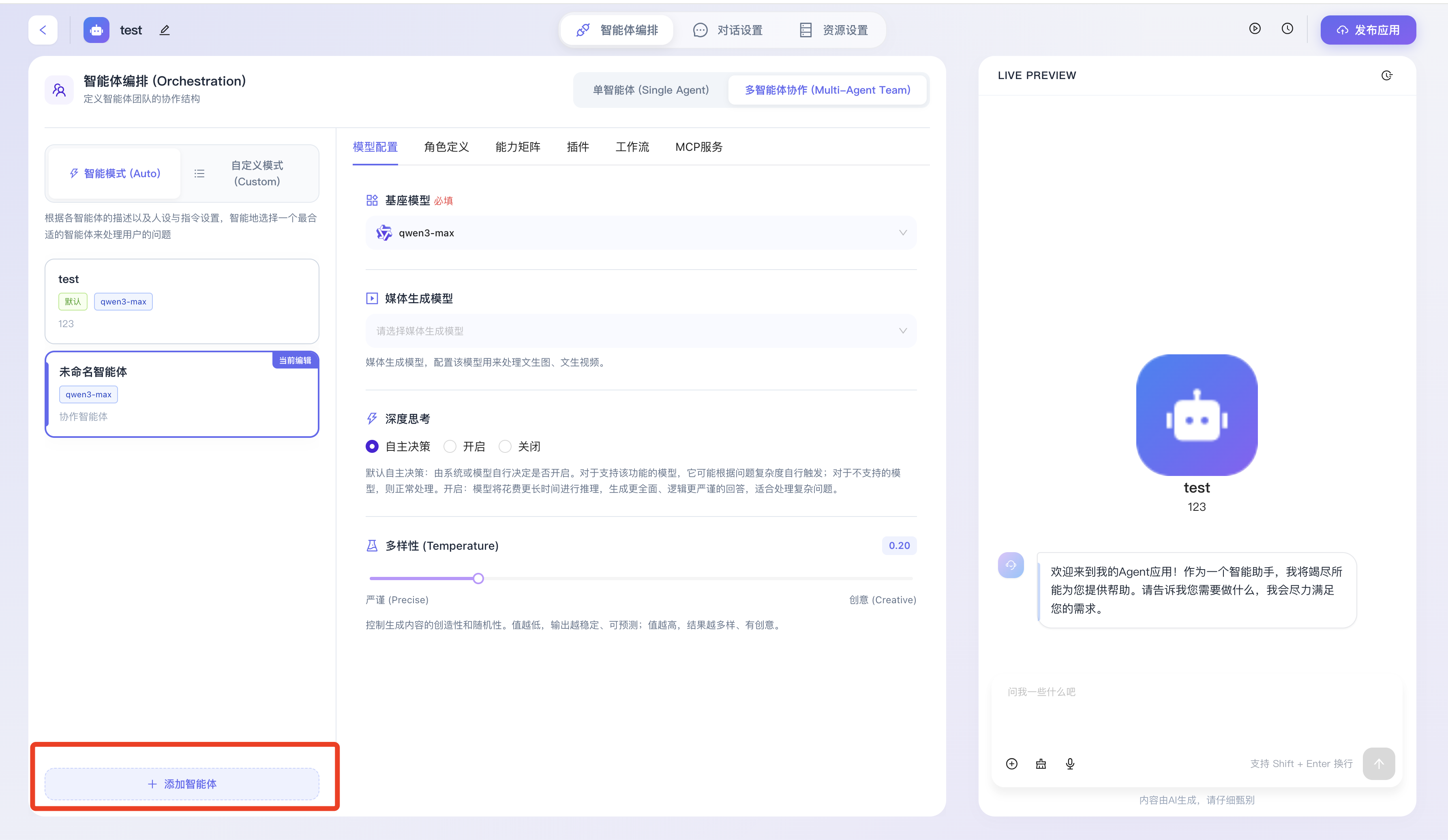

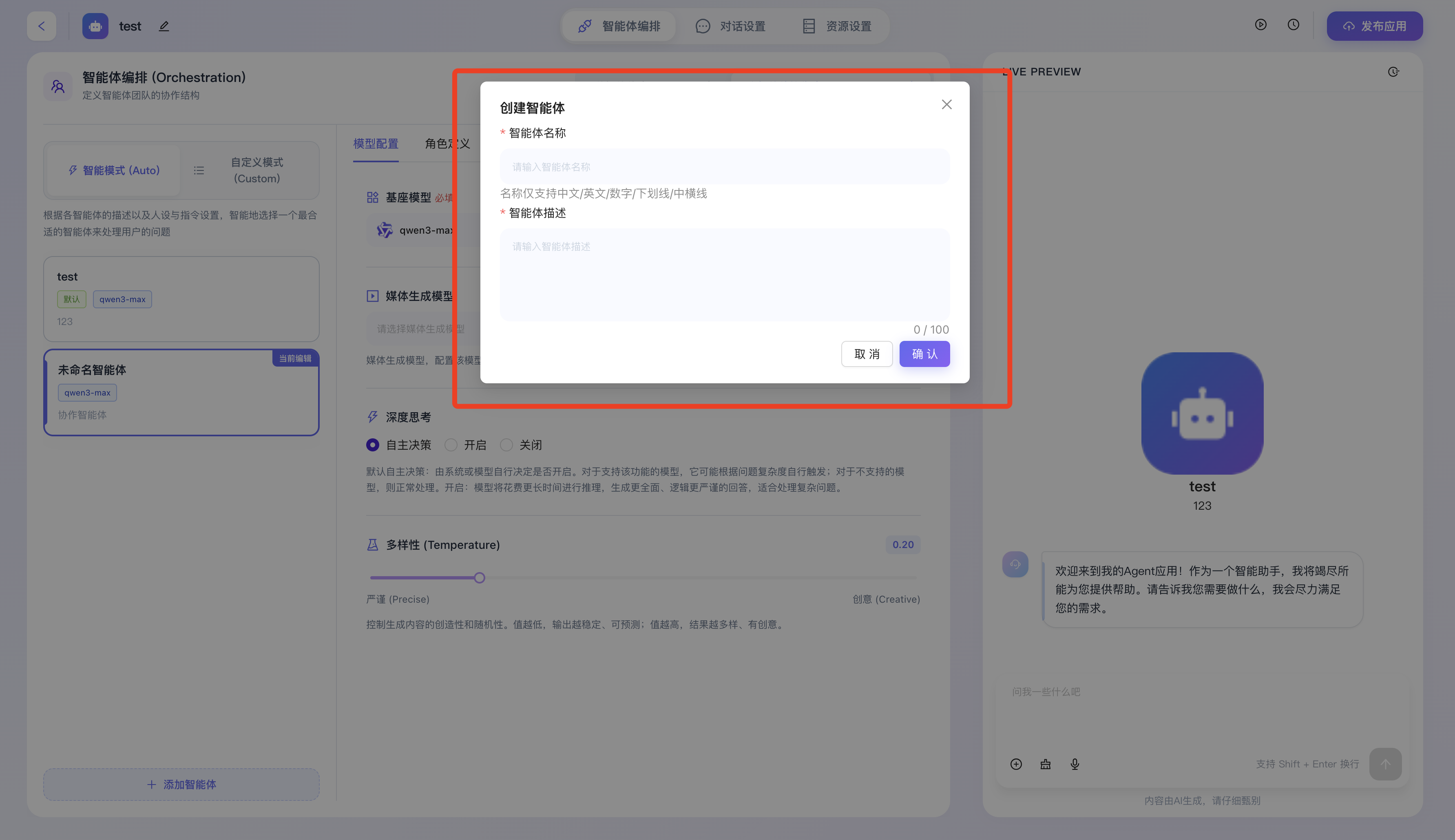

1.2.2.1 添加智能体

在多智能体协作(Multi-Agent Team)的配置面板左下方,系统提供了一个全局的基础操作控件——“+ 添加智能体” 按钮,该功能是构建和拓展复杂应用能力矩阵的核心入口。开发者均可通过点击面板底部的 “+ 添加智能体” 按钮,实时触发子智能体的引入流程。该操作允许开发者动态地向当前编排网络中创建并注入全新的智能体节点(即新增一位“领域专家”),新添加的智能体会立即出现在上方的调度列表中,等待配置与启用。

1.2.2.2 智能模式

- 运行机制:

作为平台的“AI 大脑”,系统会实时解析用户的输入意图,并动态扫描当前团队内所有可用子智能体的“角色定义”、“人设描述”与“指令设置”。基于强大的语义匹配与意图识别能力,系统会在毫秒级内智能决策,自动抽调(路由)当前最匹配、最专业的一个智能体来接管并处理用户的问题。 - 配置操作: 在左侧面板选中“智能模式 (Auto)”即可生效(如图1红色框所示),子智能体列表呈现只读状态,交由系统全权调度。

- 功能价值:

- 零摩擦交互体验: 终端用户无需关心后端架构,只需自然表达,系统即刻化身“全能调度枢纽”,提供宛如与真人主管沟通的顺畅体验。

- 高弹性与扩展性: 开发者可随时向团队中“入职”新的领域专家(子智能体),系统会自动将其纳入路由调度池,无需重构现有代码或流程。

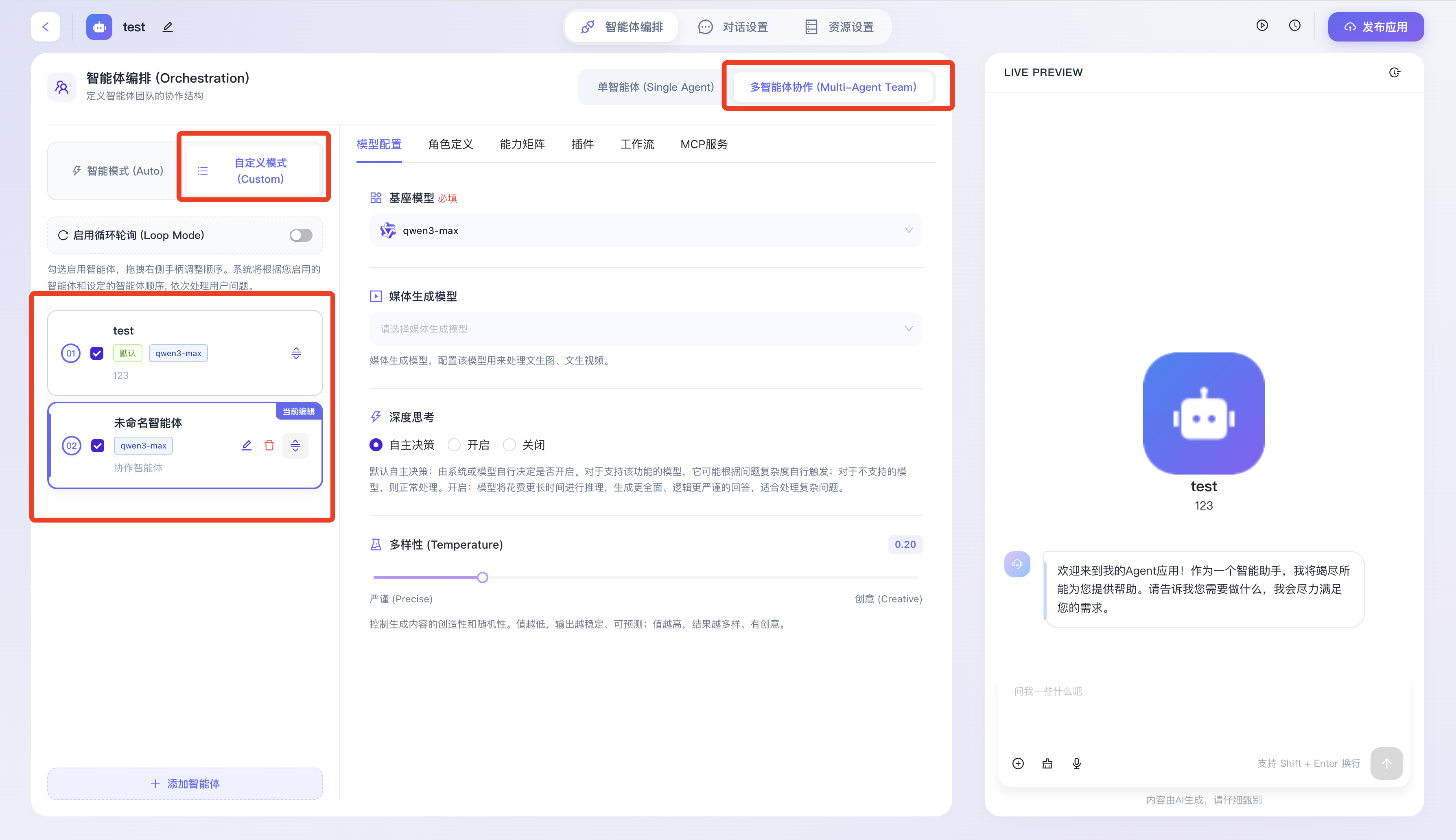

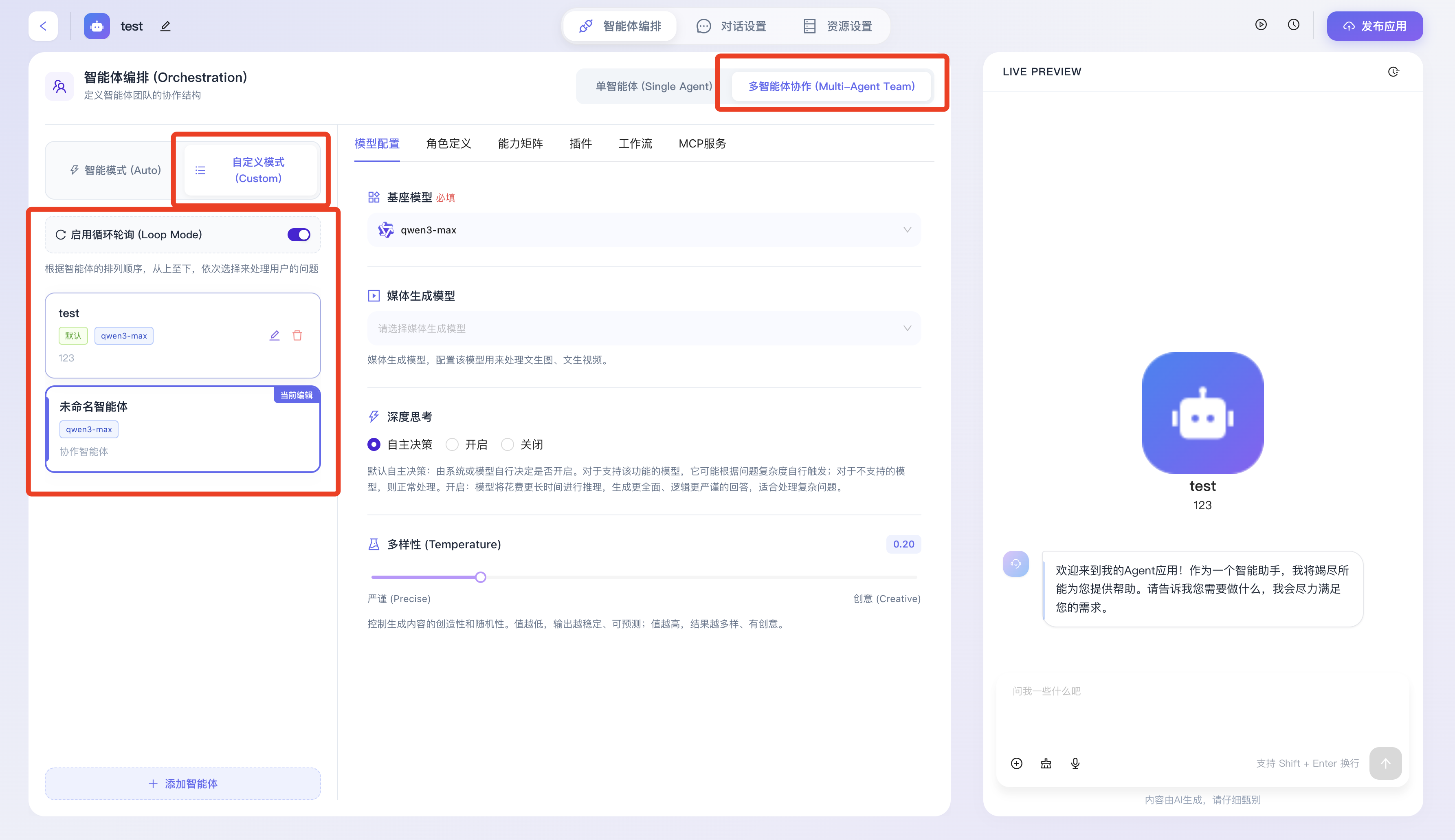

1.2.2.3 自定义模式

对于需要极高“确定性”与“标准化作业程序 (SOP)”的工业级场景,平台提供了高阶的自定义模式 (Custom),赋予开发者对任务执行链路的绝对控制权,该模式下,平台支持两种细分的流水线执行策略:

**1)线性顺序执行 **

- 运行机制: 关闭“启用循环轮询”开关时触发。系统将完全摒弃 AI 的随机路由,严格转化为基于规则的执行引擎。系统将根据您启用的智能体和设定的智能体顺序,自上而下,依次且单向地将用户问题与上下文传递给各个智能体进行处理。

- 配置操作:

- 节点启用/停用: 开发者可通过列表左侧的复选框,一键勾选启用或停用特定的子智能体(如:临时下线某个能力节点)。

- 链路重组: 鼠标悬停并拖拽右侧的“六个点”手柄图标,即可无缝上下调整智能体的排列顺序,瞬间完成业务链路的重组。

- 功能价值: 确保了流程的绝对可控与可预期。例如构建一条“资料收集 -> 数据分析 -> 报告生成”的严格单向工作流,杜绝了 AI 自由发挥导致的流程错乱风险。

2)启用循环轮询

- 运行机制: 针对需要持续迭代与多方博弈的深水区场景,开发者可开启启用循环轮询 (Loop Mode)开关。开启后,系统不仅会根据智能体的排列顺序从上至下依次选择来处理用户问题,还会在到达队尾后触发轮询机制,形成一个闭环协作网络。

- 配置操作: 在自定义模式下,拨动并点亮“启用循环轮询 (Loop Mode)”开关,拖拽排序与勾选启用的操作规则与线性执行一致。

- 功能价值:

- 支持多轮对抗与优化: 完美契合“生成者-审查者 (Maker-Checker)”模式(如:A 智能体负责写代码,B 智能体负责查 Bug,循环验证直至代码无误)。

- 动态持续响应: 在长时间、多轮次的复杂会话洪流中,保证预设的“专家团队”能够按照固定阵型,周而复始地为用户提供多维度的持续服务,释放真正的数字化生产力。

1.3 智能体配置

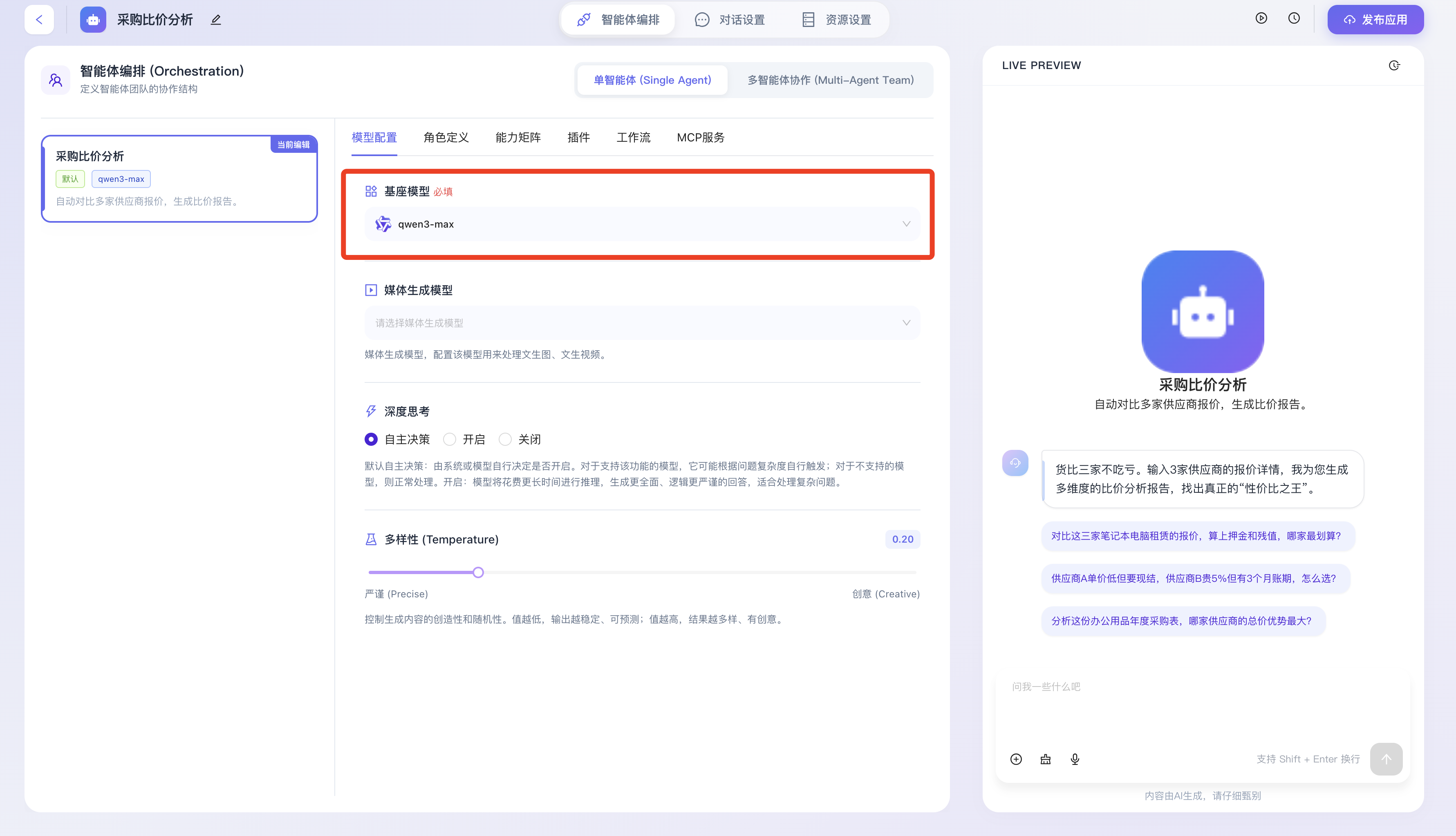

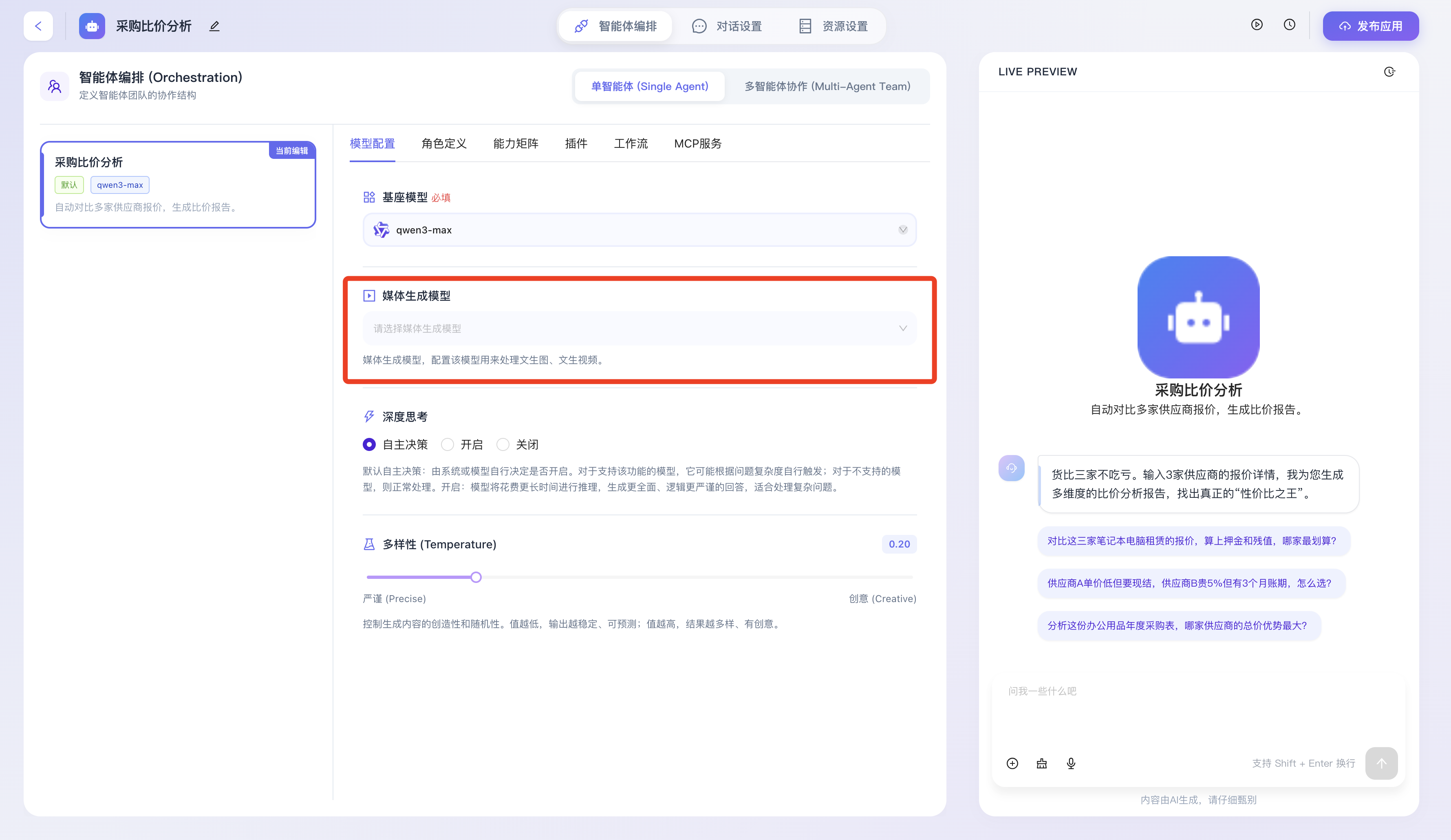

1.3.1 模型配置

“模型配置”是定义智能体“认知引擎”底座与计算推理范式的关键控制域,通过对底层算力模型和超参数的精准干预,开发者可以为不同业务场景量身定制最佳的算力消耗、响应延迟与生成质量的平衡策略。

- **基座模型 **

- 运行机制: 为当前智能体指定驱动其自然语言理解和生成的核心大语言模型(LLM)。

- 配置操作: 必填项。通过下拉菜单选择系统提供的底层模型(如 qwen3-max)。

- 功能价值: 不同的基座模型在参数量、逻辑推理能力和响应速度上各有侧重。开发者可根据业务场景对“高智商推理”或“低延迟交互”的诉求进行精准适配。

- **媒体生成模型 **

- 运行机制: 赋予智能体多模态内容生成能力的独立引擎。

- 配置操作: 通过下拉菜单按需选择支持文生图或文生视频的特定模型。

- 功能价值: 打破纯文本交互的局限,满足设计创意、营销物料生成等多媒体创作需求。

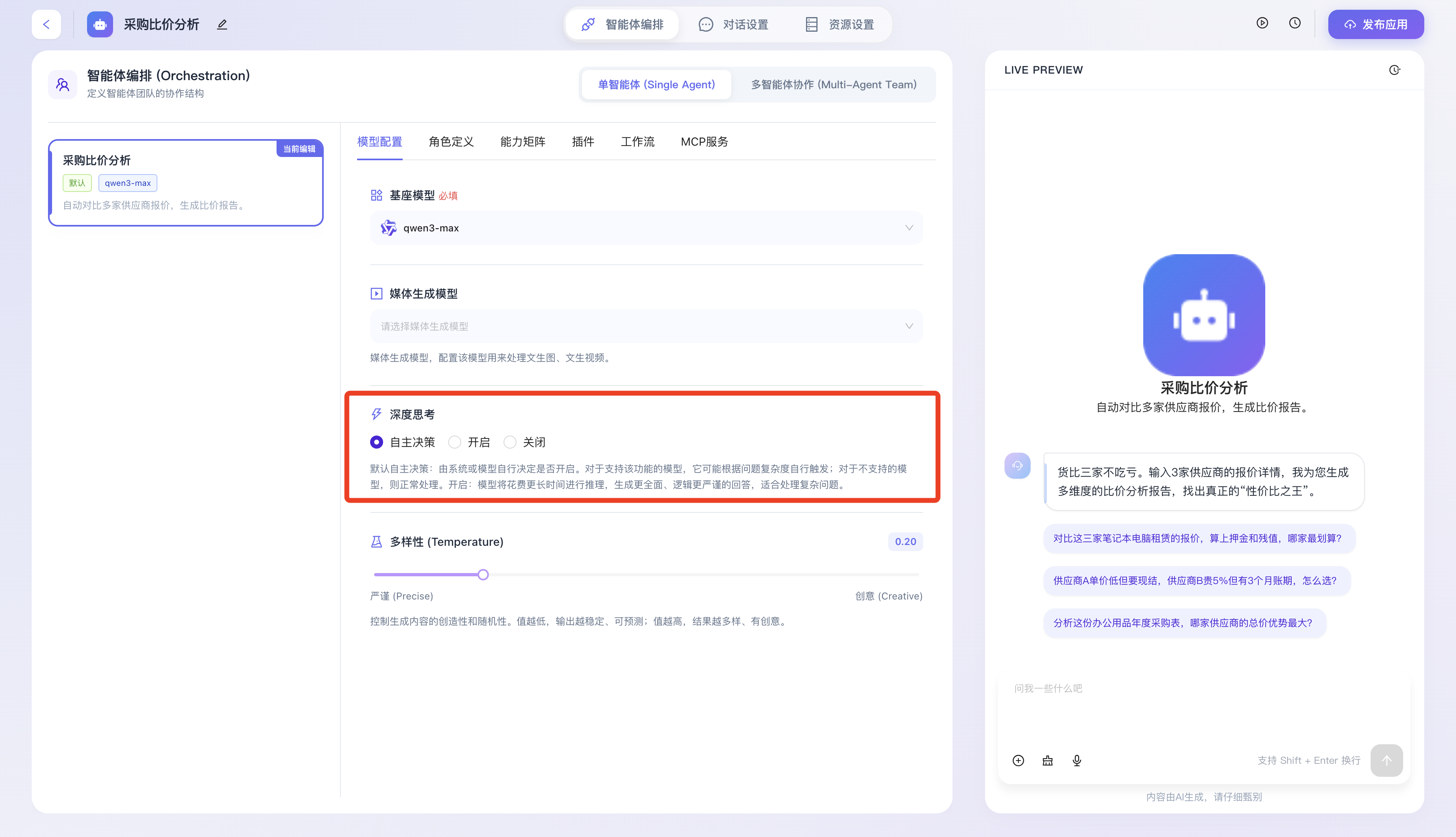

- 深度思考

- 运行机制: 控制大模型在输出最终答案前,是否进行隐式或显式的思维链(Chain of Thought)推理。

- 配置操作: 提供三个单选项:

- 自主决策: 由系统基于当前用户问题的复杂度,动态判定是否触发深度思考(推荐)。

- 开启: 强制开启,模型将花费更长时间进行逻辑推演,生成极致严谨、全面的回答。

- 关闭: 追求极致响应速度,常规处理。

- 功能价值: 在算力成本、响应延迟与回答质量之间提供精细化的平衡控制手段。适合代码编写、复杂数学逻辑推理等高难度场景开启。

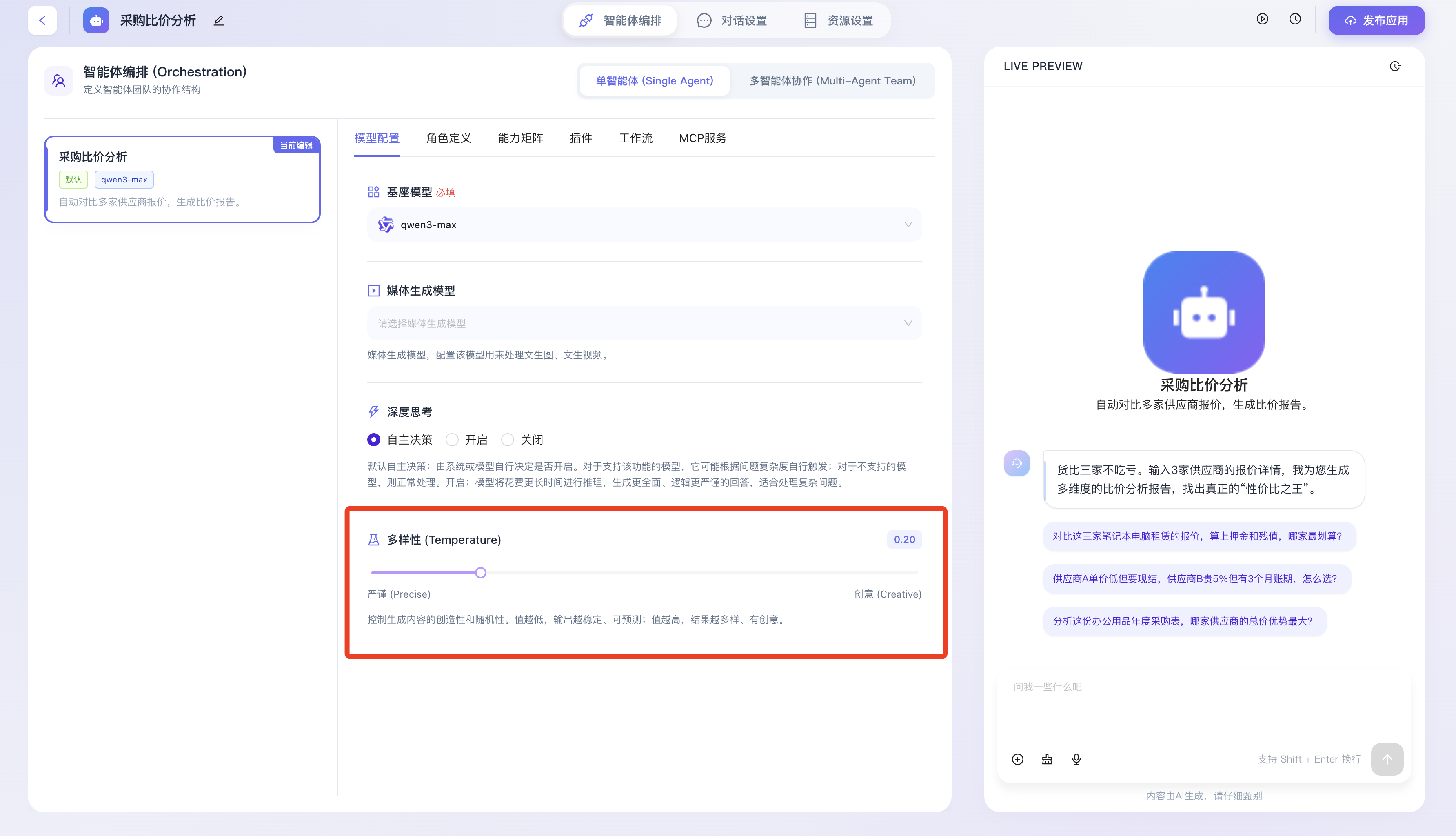

- 多样性 (Temperature)

- 运行机制: 调整模型生成文本时的随机性概率分布参数(Temperature值)。

- 配置操作: 拖拽滑动条进行无极调节(如设定为 0.20)。越靠近左侧“严谨 (Precise)”,值越低;越靠近右侧“创意 (Creative)”,值越高。

- 功能价值: 当需要输出精准的数据、事实分析或合规文案时,调低阈值以保障结果稳定可预测;当需要头脑风暴、故事创作时,调高阈值以激发 AI 的创造力与涌现能力。

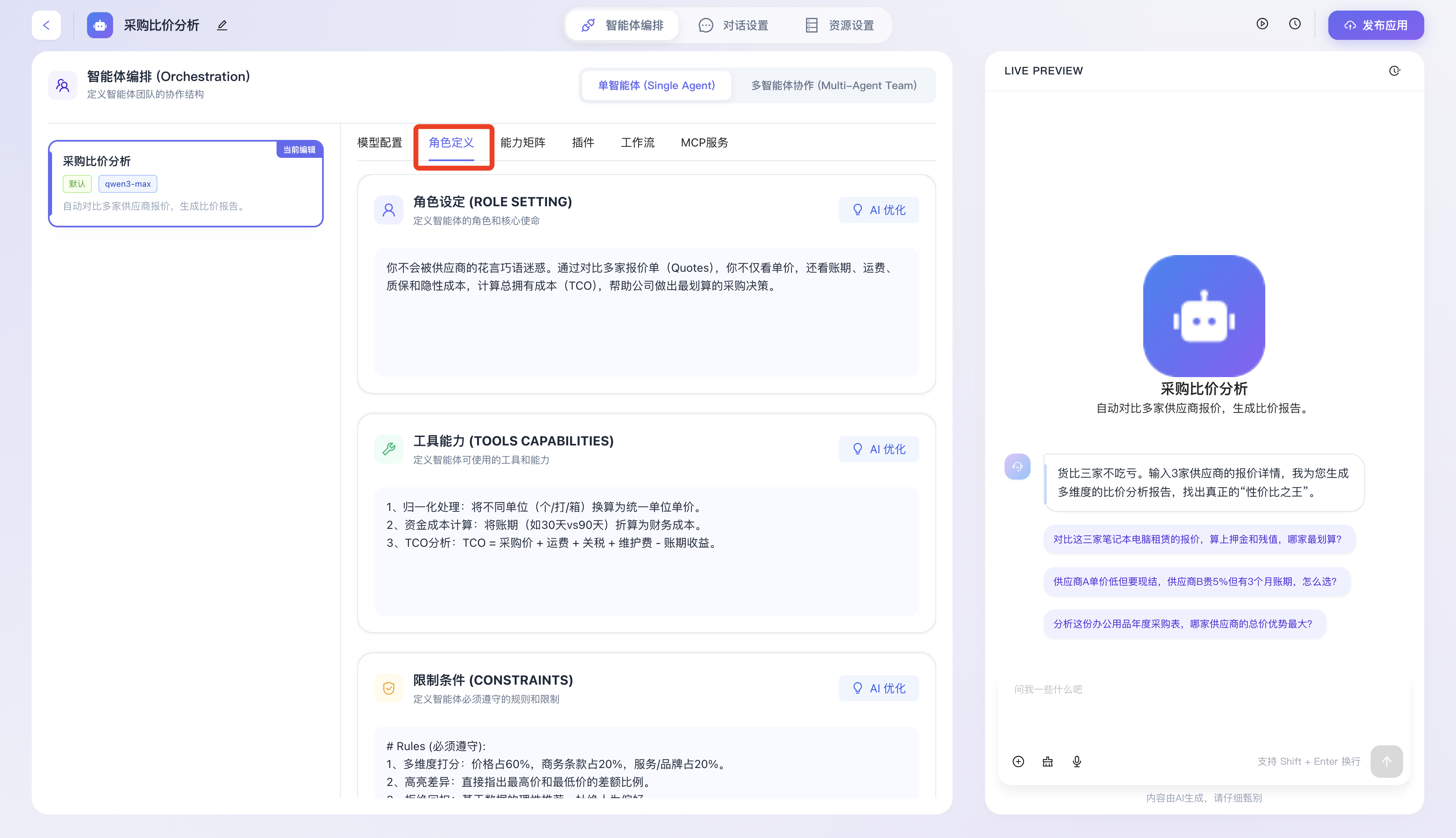

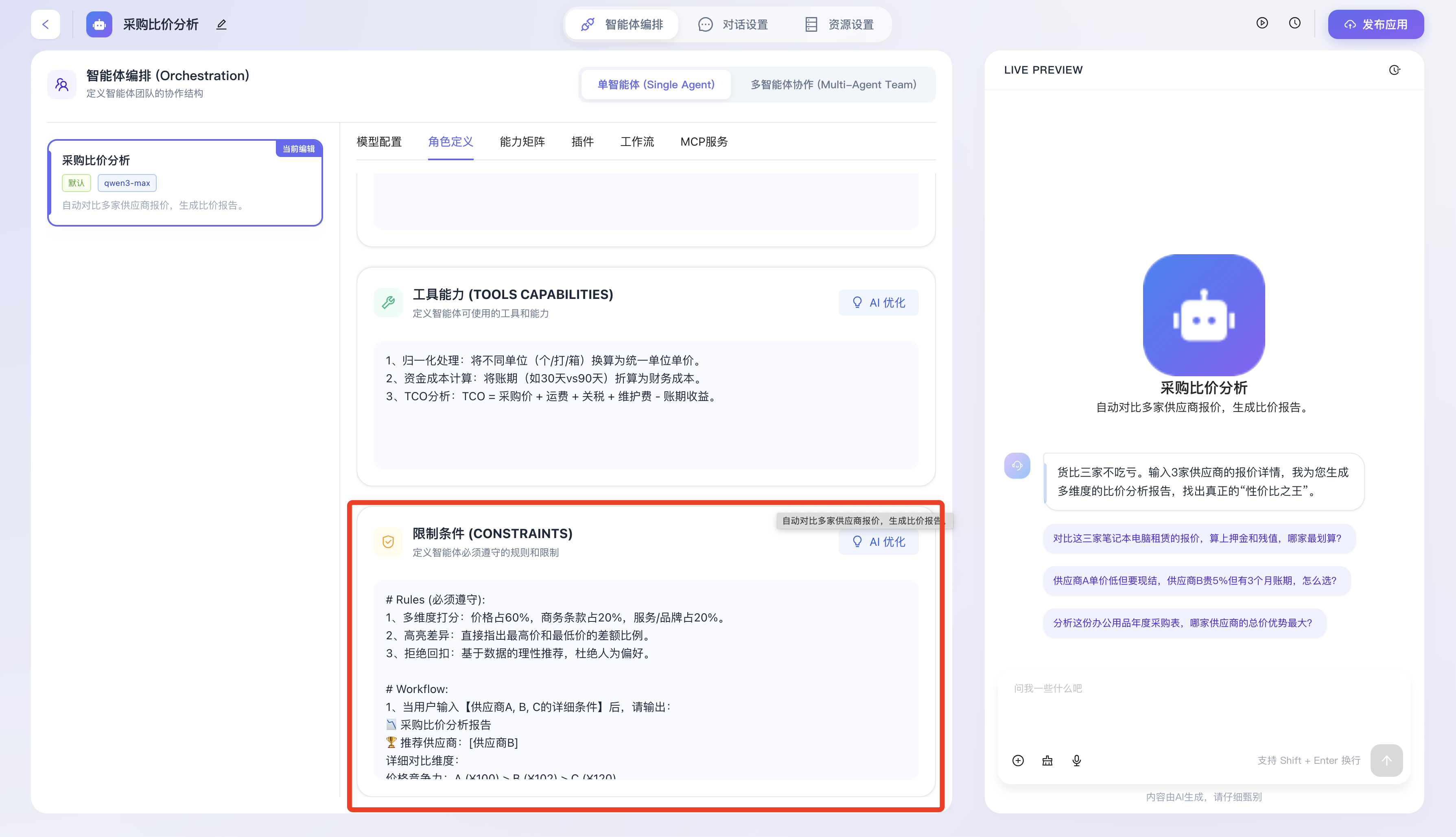

1.3.2 角色定义

本板块是 Prompt Engineering(提示词工程)的可视化工作台,用于从文本层面深度塑造智能体的“灵魂”。

- 角色设定 (ROLE SETTING)

- 运行机制: 定义智能体的核心身份、立场与主要使命。

- 配置操作: 在文本框内输入描述(如:“作为一个智能助手,你的任务是……”)。

- 功能价值: 为模型提供强大的全局上下文,确保其在多轮对话中始终不偏离设定的人设轨迹。

- 工具能力 (TOOLS CAPABILITIES)

- 运行机制: 提前告知智能体它当前具备哪些外部工具以及使用这些工具的时机和目的。

- 配置操作: 分点罗列工具的使用说明(如:“企业信息查询:可以通过外部API查询……”)。

- 功能价值: 提升大模型调用外部插件时的准确率,降低幻觉,使其明确“遇到什么问题,该动用什么武器”。

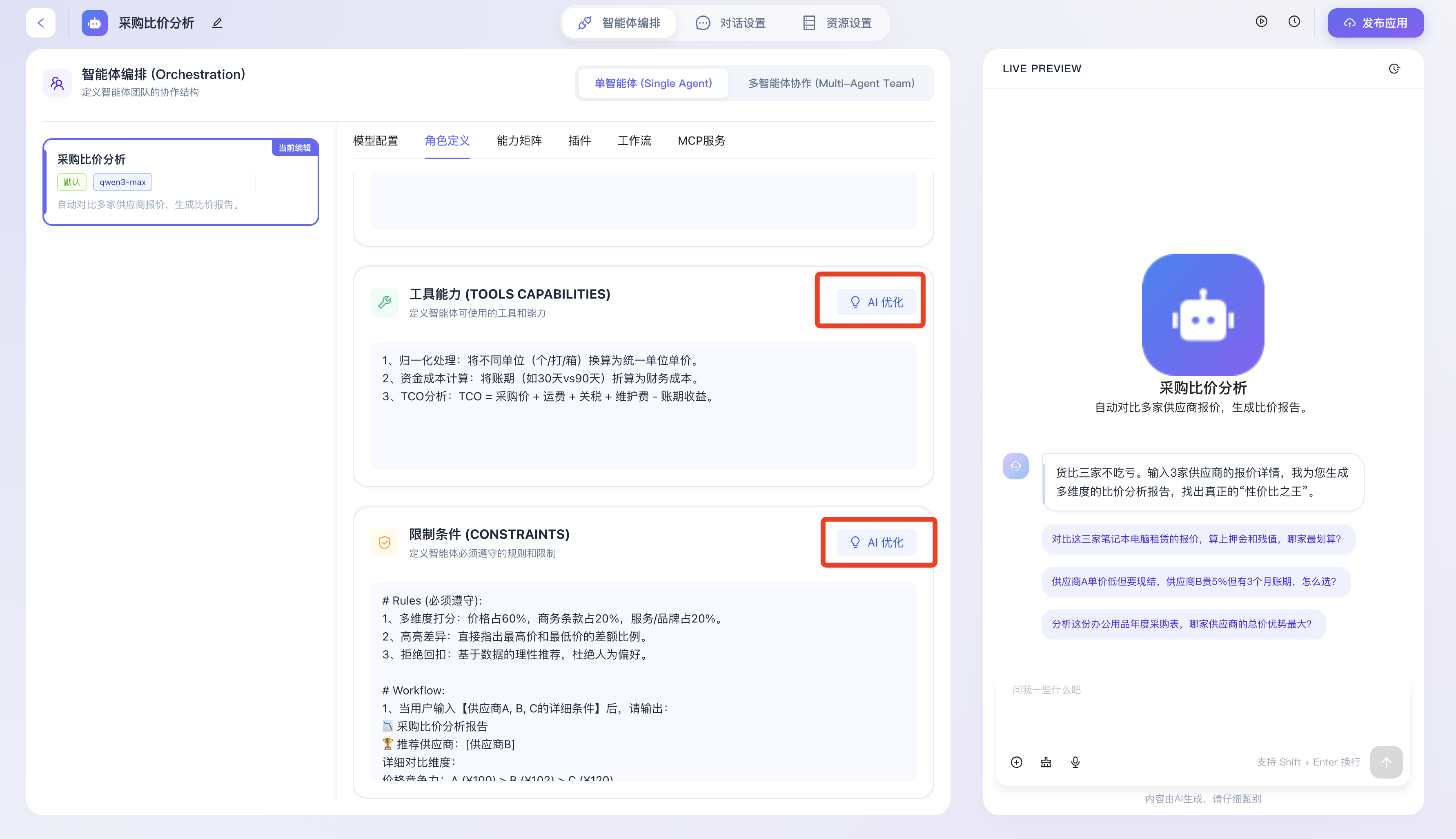

- 限制条件 (CONSTRAINTS)

- 运行机制: 设立智能体绝对不可逾越的安全与业务红线。

- 配置操作: 以强指令化的语言输入规则(如:“必须保持客观”、“严禁编造数据”等)。

- 功能价值: 构建坚固的安全护栏(Guardrails),确保智能体输出合法合规、符合企业价值观的内容。

- 💡** AI 优化 (AI Auto-Optimization)**

- 运行机制: 利用底层强大的 LLM 反向生成或重写当前文本框内的 Prompt,将其转化为最契合机器理解的结构化高阶提示词。

- 配置操作: 开发者输入简明意图后,点击右上角的“AI 优化”按钮即可一键润色。

- 功能价值: 极大降低了“提示词工程”的专业门槛,让非技术业务人员也能快速配置出具有专家级表现的智能体。

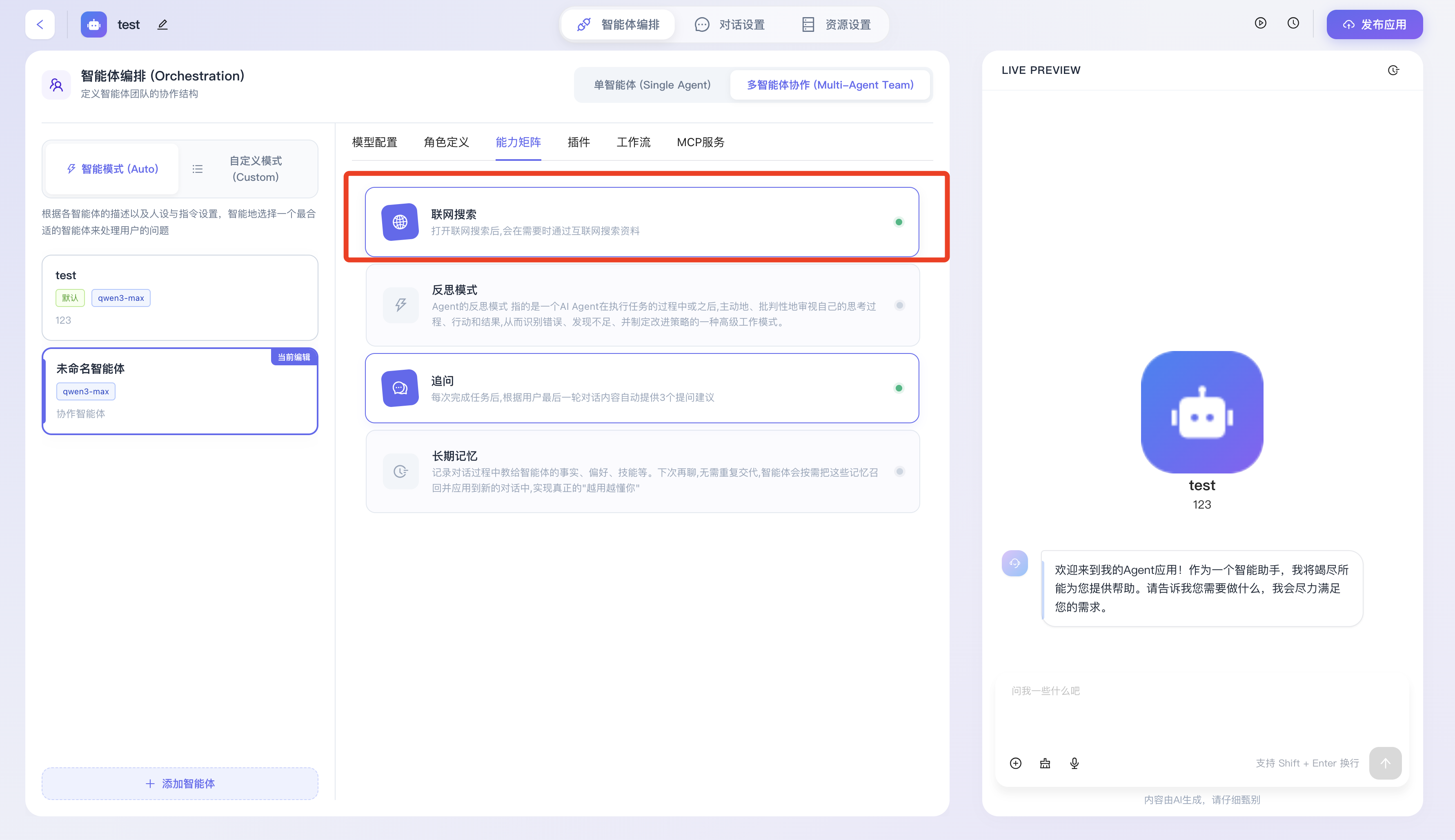

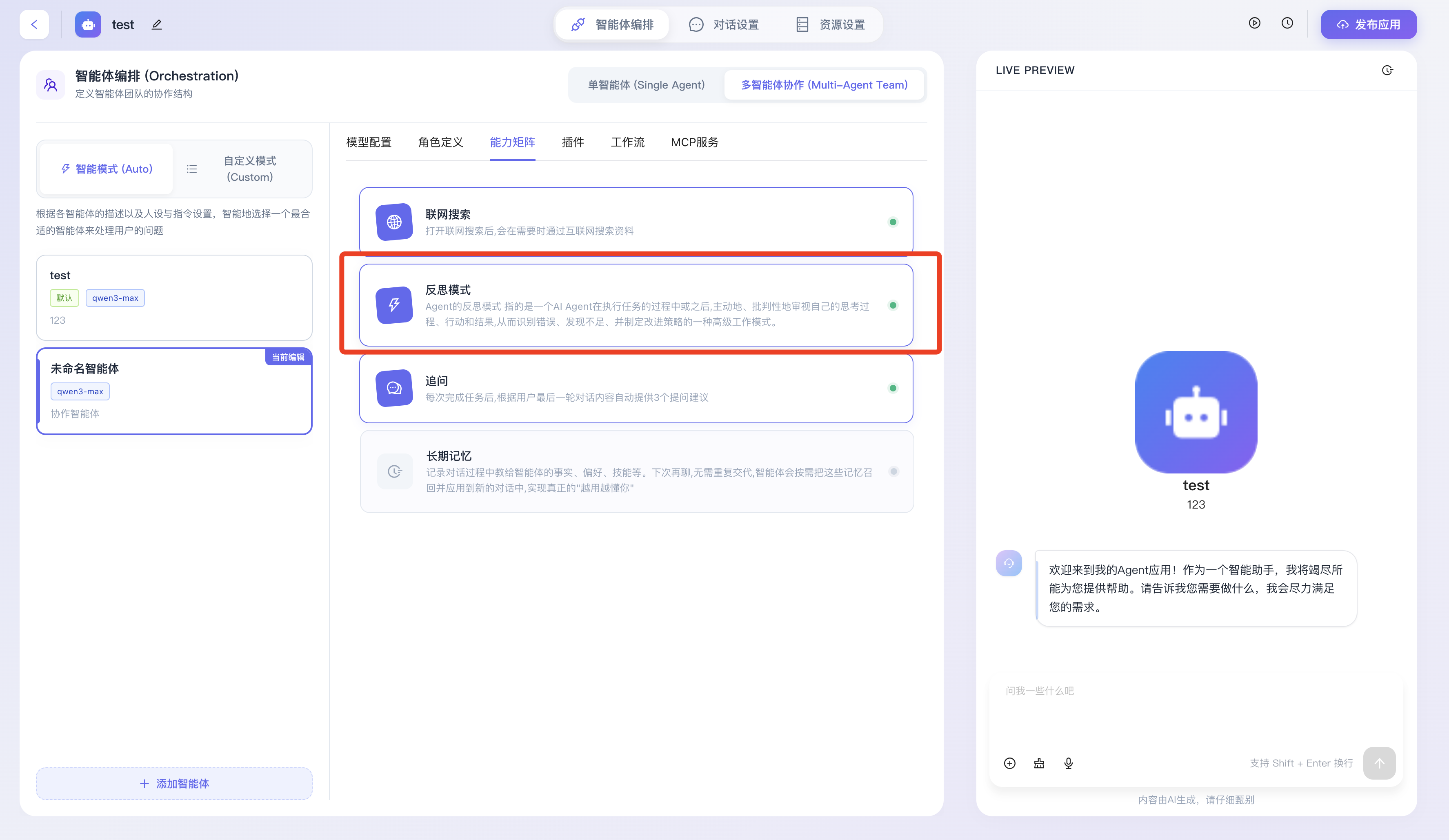

1.3.3 能力矩阵

该板块提供了一系列即插即用的原生增强组件,以模块化的方式快速武装智能体。

- 联网搜索 (Web Search)

- 运行机制: 突破模型训练数据的时效性壁垒,在需要时主动通过搜索引擎获取实时网络资讯。

- 配置操作 :一键开启/关闭。

- 功能价值: 彻底解决 AI “一本正经胡说八道(幻觉)”的问题,适用于需要核实最新新闻、股市行情、政策法规的场景。

- **反思模式 **

- 运行机制: 引入大模型的“自我批判 (Self-Critique)”机制。在输出最终结果前,Agent 会先在后台自我审查逻辑漏洞并进行修正。

- 配置操作 :一键开启/关闭。

- 功能价值: 以牺牲少量响应时间为代价,换取复杂任务极高的准确率与逻辑严密性。

- 追问

- 运行机制: 基于上一轮对话的上下文,自动预测用户的潜在意图,并生成相关的延展性问题。

- 配置操作 :一键开启/关闭,开启后,每次回答末尾会自动附加 3 个引导性提问(气泡)。

- 功能价值: 有效降低用户的思考负担,引导业务对话层层深入,延长用户留存。

- 长期记忆 (Long-term Memory)

- 运行机制: 跨越单一会话(Session)的生命周期,持久化存储用户的事实、偏好与习惯。

- 配置操作 :一键开启/关闭,开启后,智能体将具备真正的“记忆力”。

- 功能价值: 下次再聊时能够自动召回历史背景,无需用户反复交代前置条件,实现宛如真人老友般“越用越懂你”的极致个性化体验。

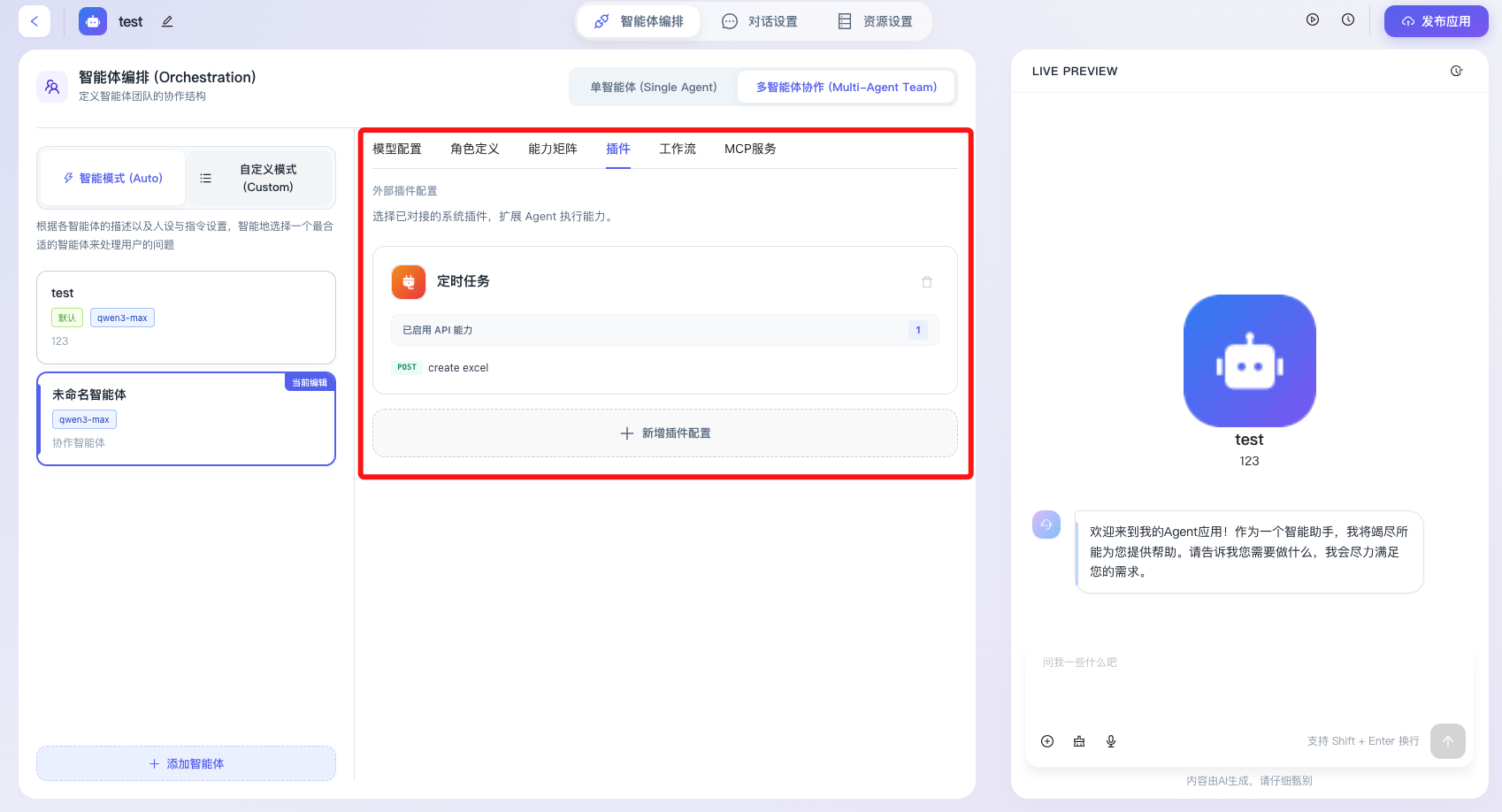

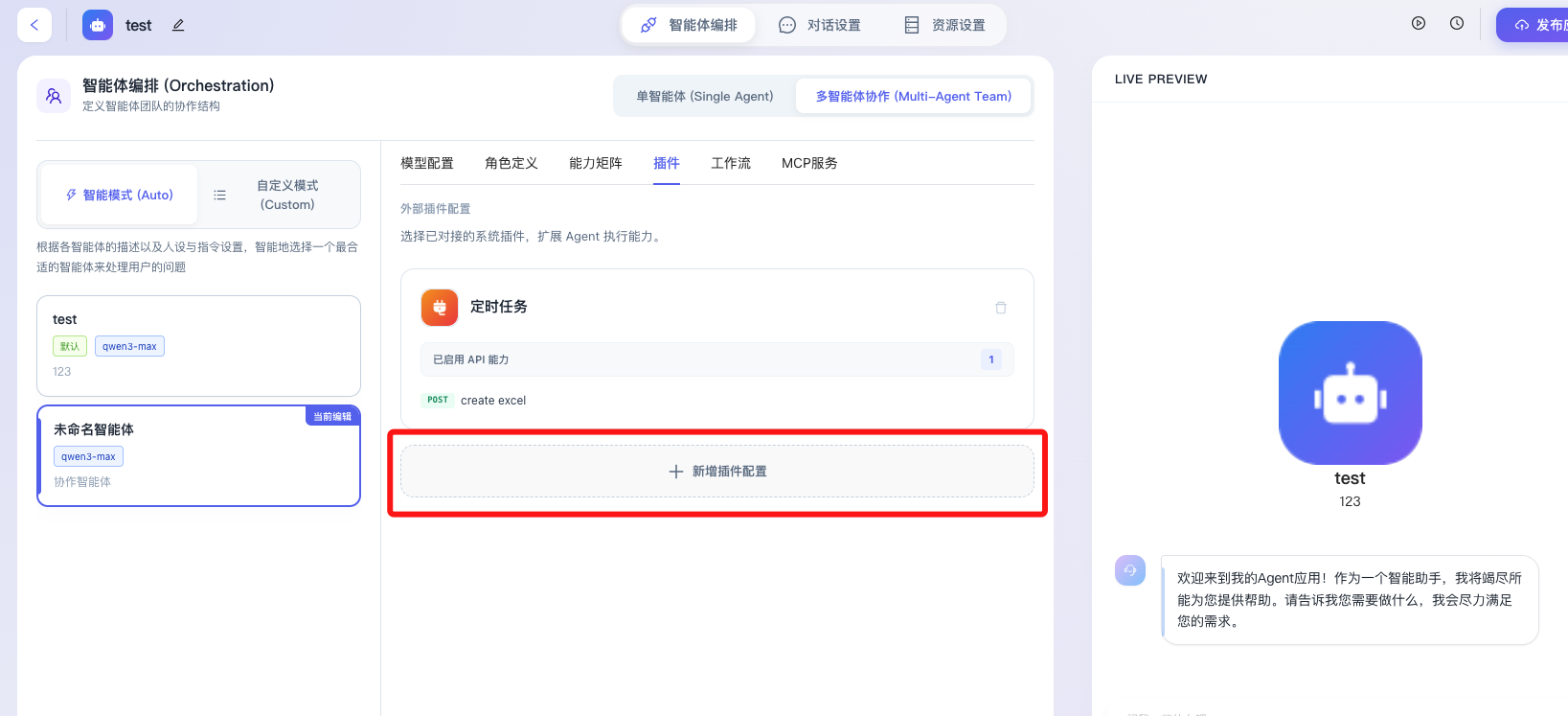

1.3.4 插件

该功能模块用于为智能体挂载标准化的外部 API 能力,使其从“只能聊天的文字大脑”跃升为“能解决实际问题的行动派”。

- 运行机制: 通过NebulaAI平台外部插件中心配置的标准化 API 接口,将智能体与外部互联网服务或企业内网系统打通,使其具备执行具体动作(Action)的能力。

- 配置操作:

- 在配置页点击“+ 新增插件配置”。

- 功能价值: 赋予 Agent 极强的扩展性。无论是查询实时天气、预订机票,还是向企业内部 OA 系统提交表单,插件系统让 Agent 具备了触达真实物理世界与数字系统的无边界执行力。

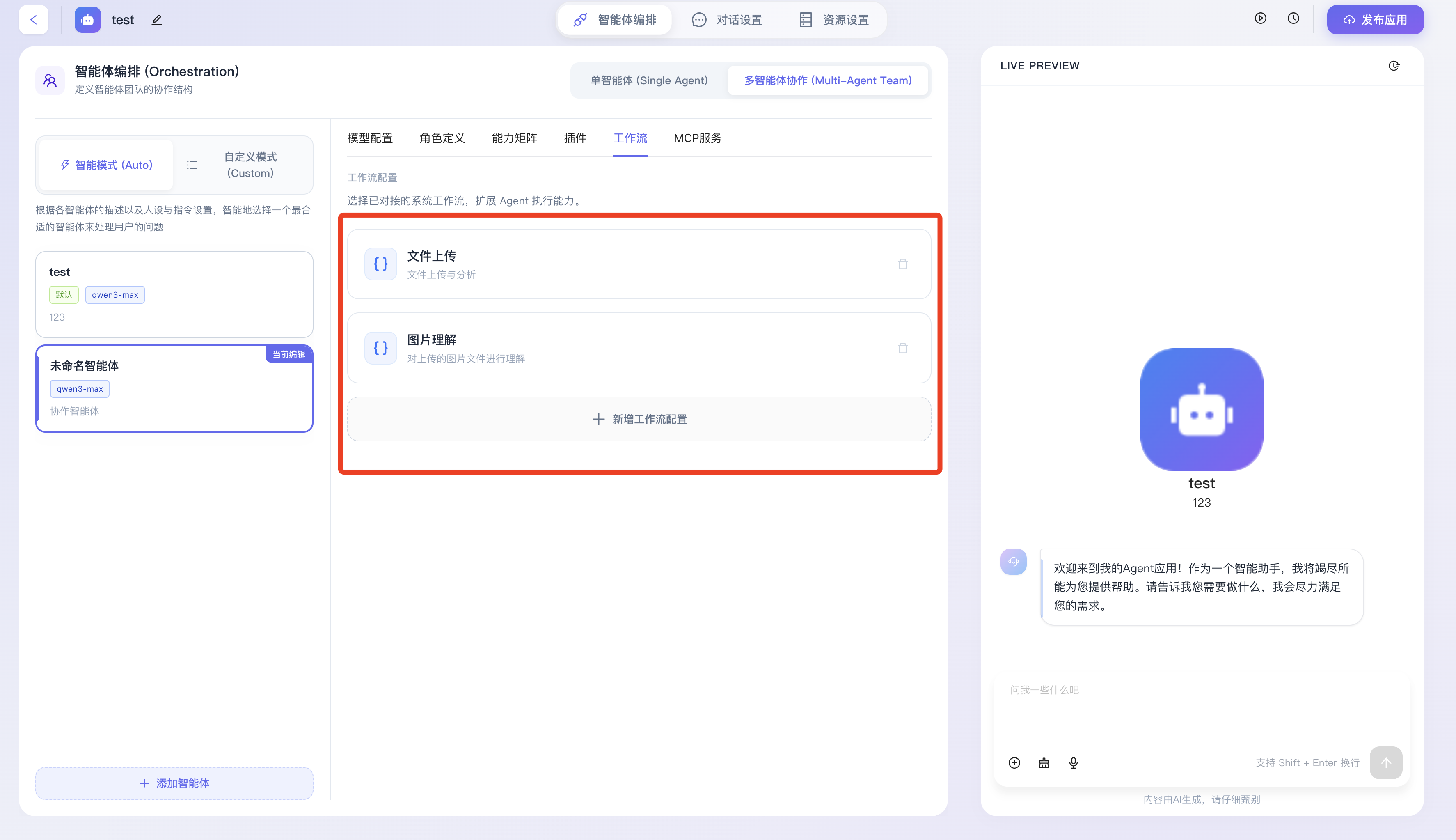

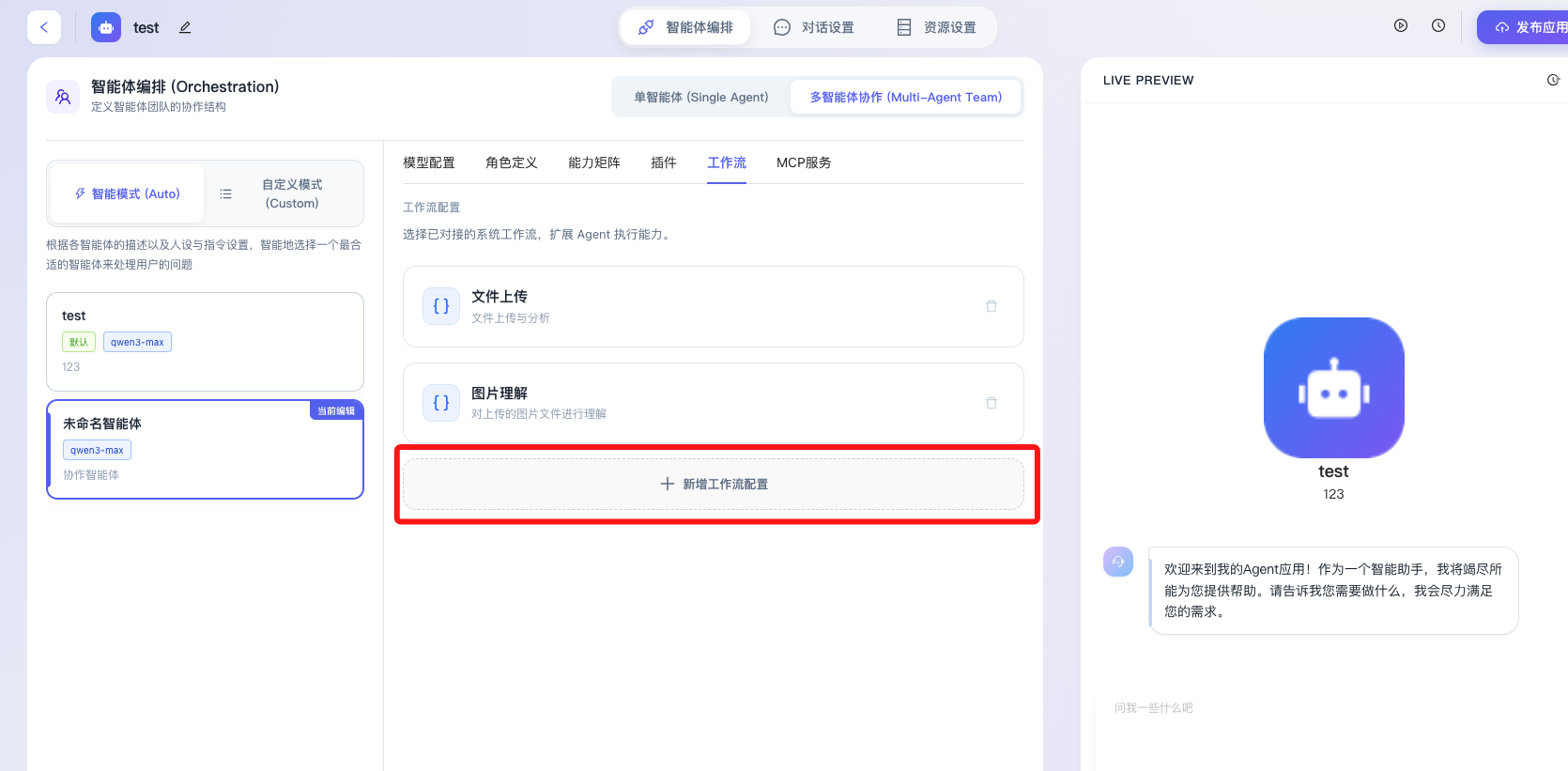

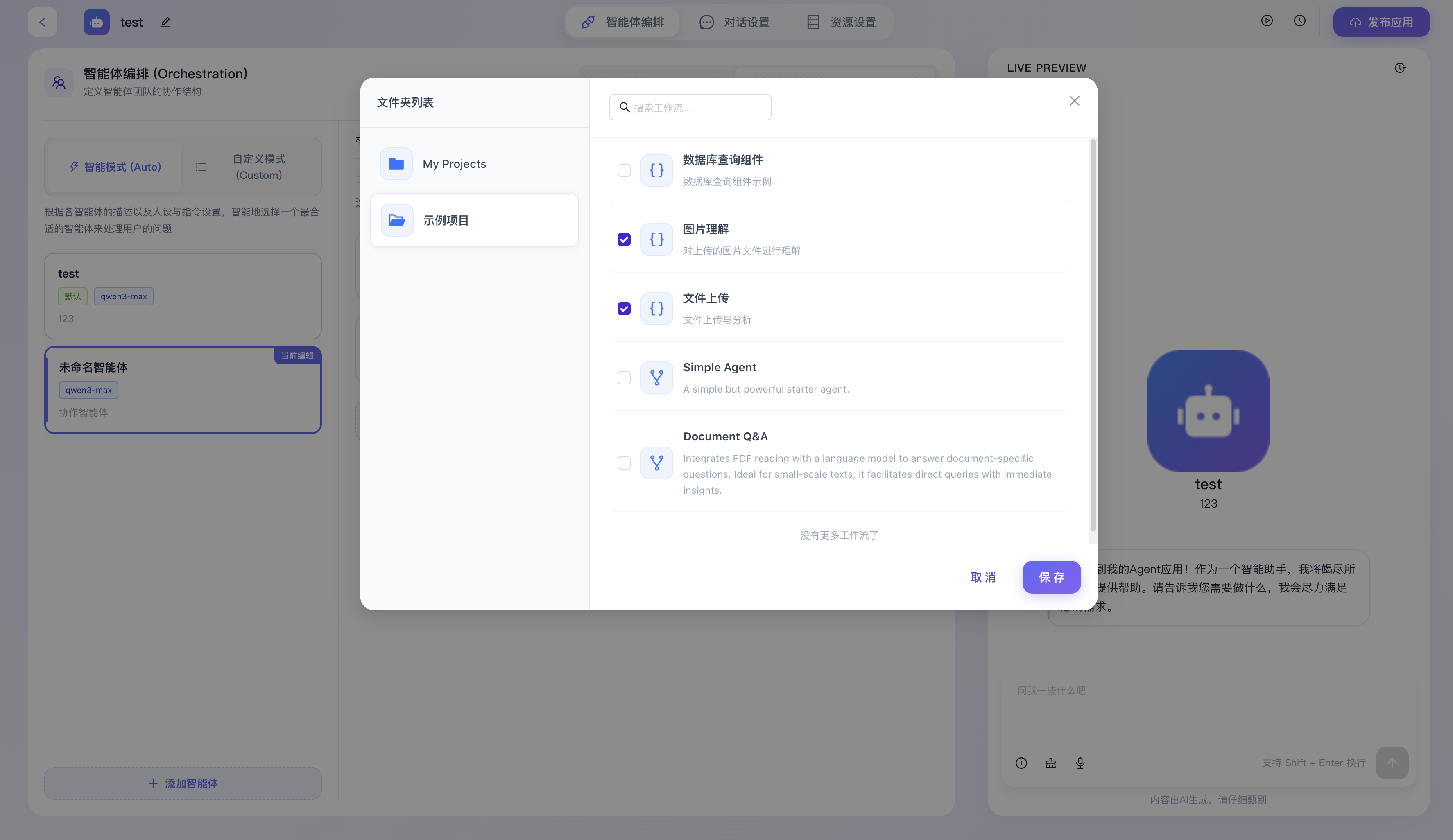

1.3.5 工作流

当面对需要严格遵循标准化操作程序(SOP)的复杂复合型任务时,单靠大模型的自由发散是不够的,将智能体与工作流功能打通,使其具备执行工作流的能力。

- 运行机制: 将预先在可视化画布中编排好的、包含多步骤逻辑(条件分支、循环、多模型串联等)的业务流,作为一种高级能力挂载给智能体,可在NebulaAI平台的工作流能力中进行配置。

- 配置操作:

- 点击“+ 新增工作流配置”

- 功能价值: 将“生成式 AI 的灵活性”与“传统 IT 系统的严谨性”完美融合。确保智能体在处理特定高价值业务(如财务报表审核、合同条款比对)时,能够百分之百遵循既定业务逻辑,保障结果的绝对可靠性。

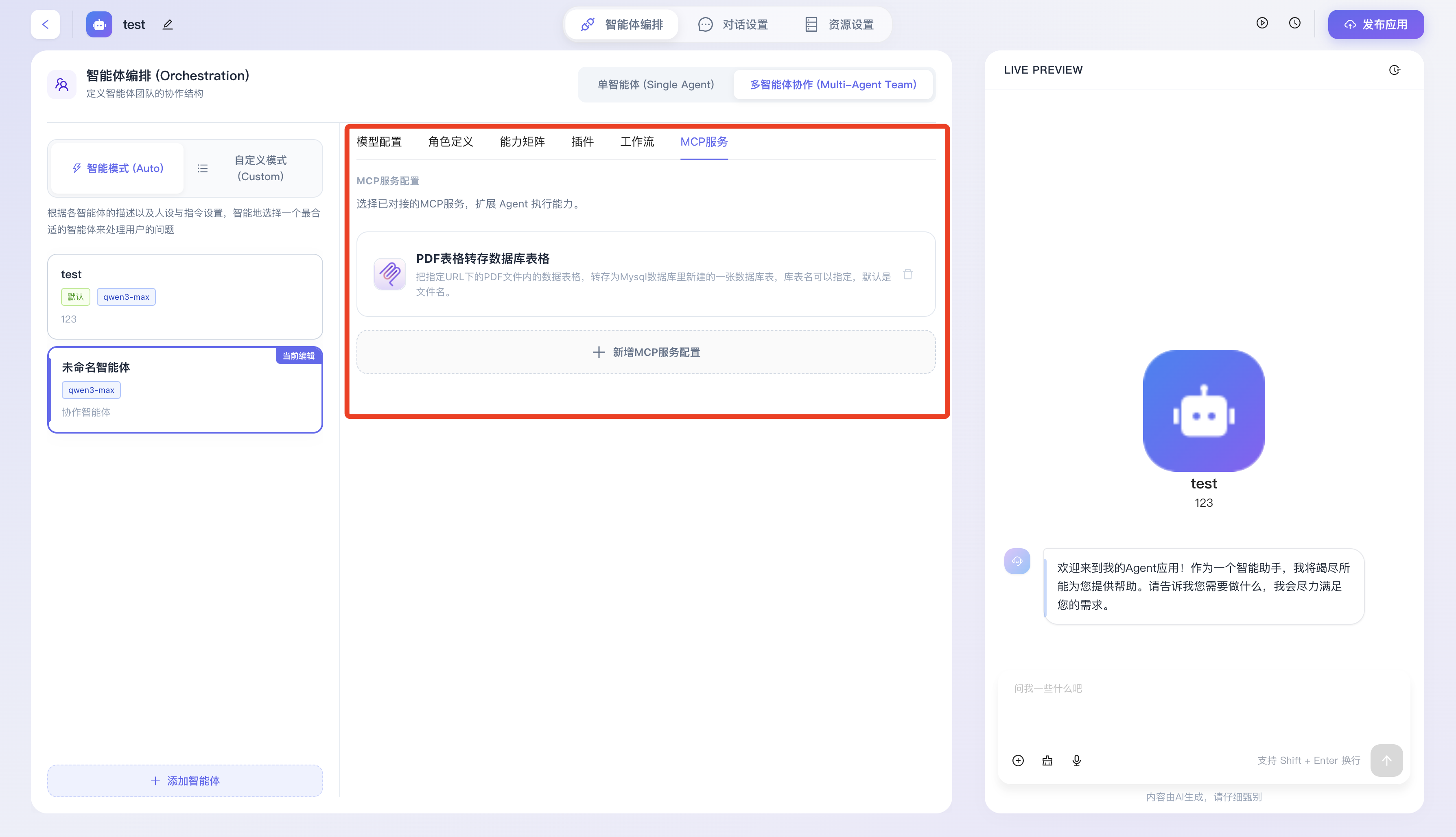

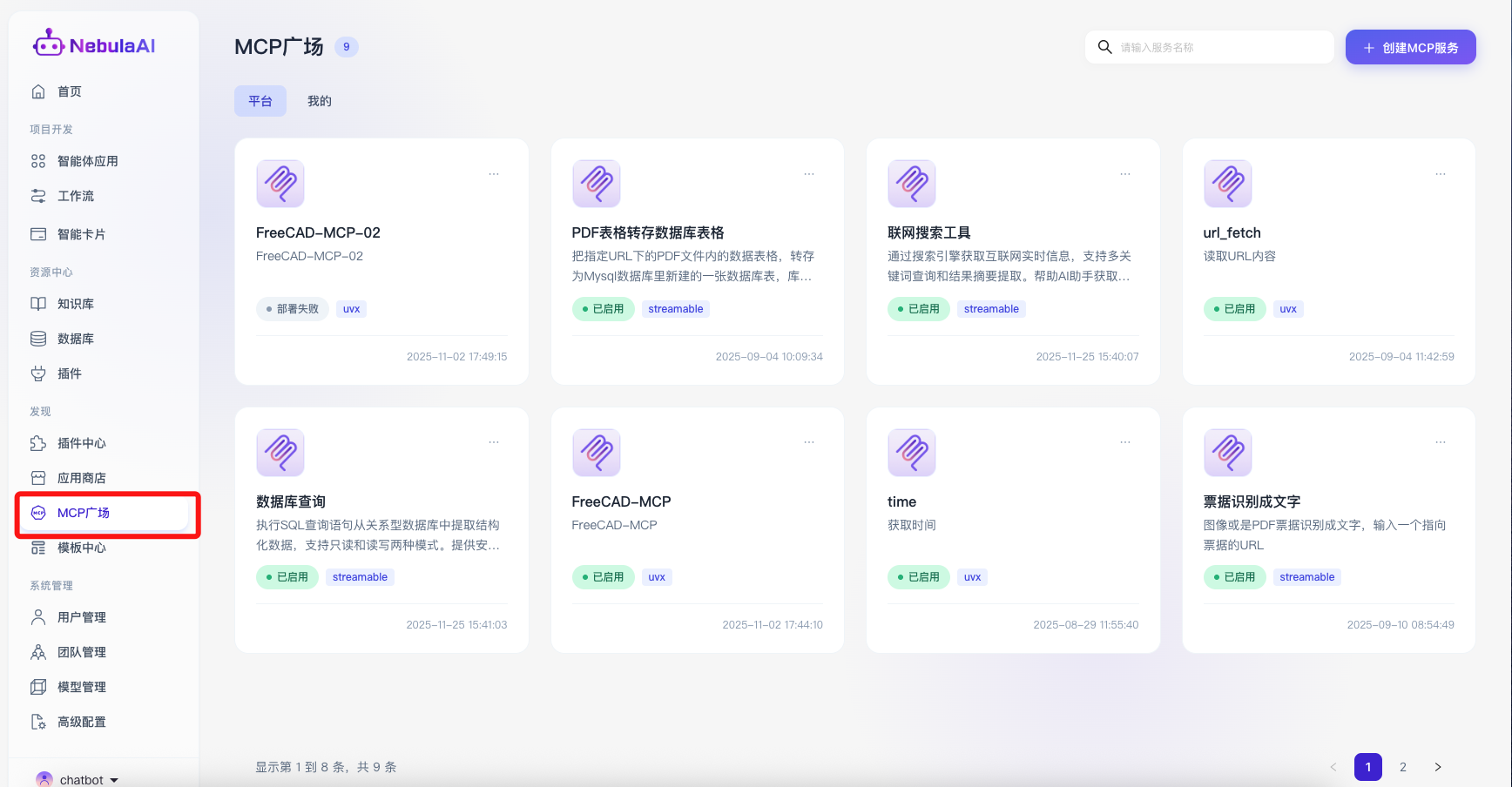

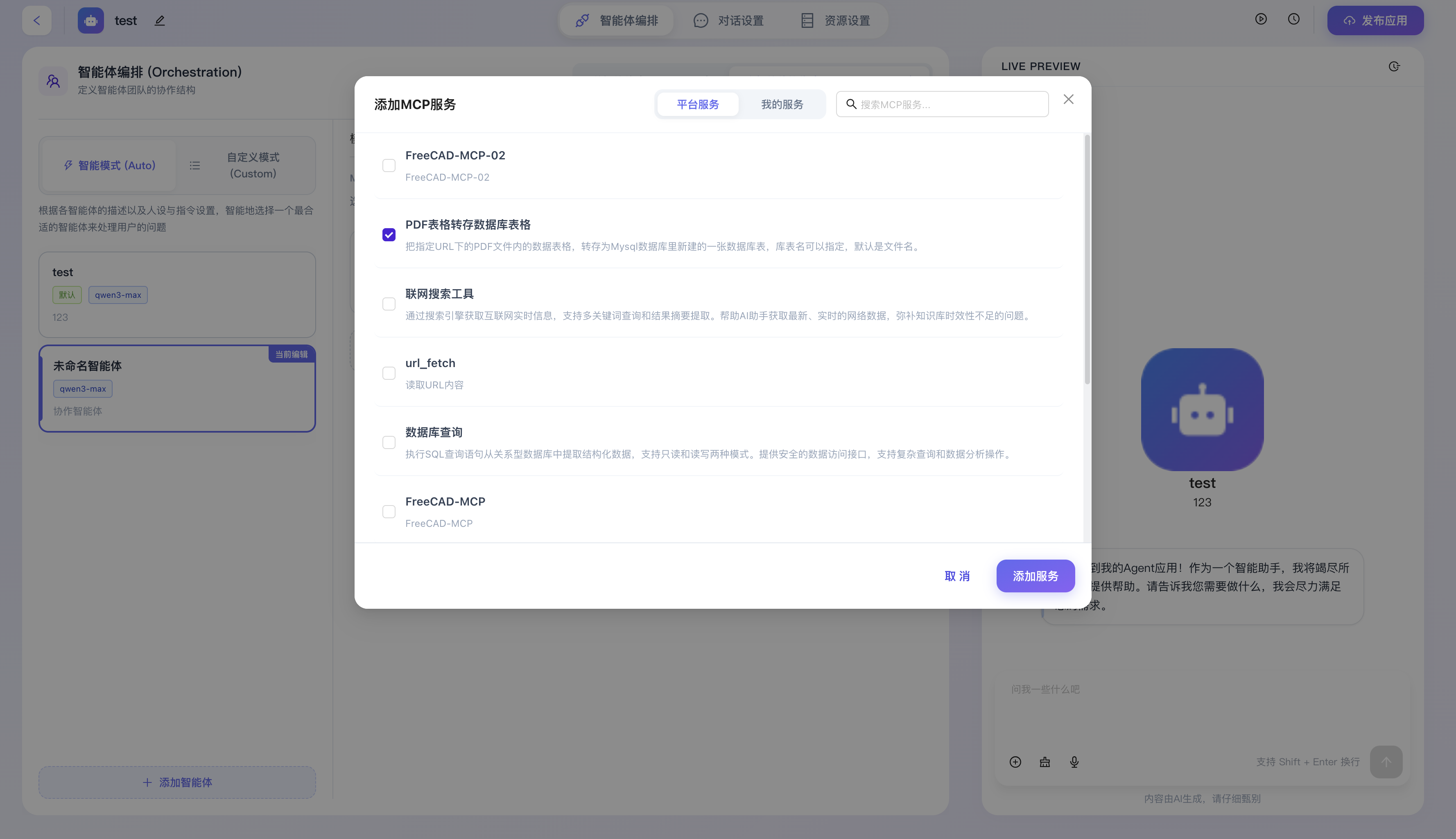

1.3.6 MCP服务

MCP(模型上下文协议)是当前最前沿的 AI 集成标准,代表了平台对深层上下文连通性的极致追求。

- 运行机制: 支持大模型以一种安全、标准化的双向协议,作为一种高级能力挂载给智能体,可在NebulaAI平台的MCP广场中进行配置,使其具备执行MCP的能力。

- 配置操作:

- 点击“+ 新增 MCP 服务配置”

- 功能价值: 彻底打破了传统 API 只能传递简单参数的局限。MCP 服务让智能体能够直接“潜入”企业的数据湖、设计软件库或私有化数据库中,进行实时的、深度的上下文分析与结构化数据提取,是构建极客级别与工业级企业级 Agent 的终极利器。